Claude Sonnet 4.6 之后:技术团队如何用“多模型分工”降本提效

2026 年 2 月,大模型更新节奏明显加快。很多团队第一反应是:要不要立刻全量切新模型?谁才是“最强”?

2026 年 2 月,大模型更新节奏明显加快。很多团队第一反应是:要不要立刻全量切新模型?谁才是“最强”?

但真正做过生产落地的人会发现,这些问题都不够关键。现在更重要的是:别再押注单一模型,而是建立“任务级多模型分工”体系。

换句话说,竞争力不再来自“你选中了谁”,而来自“模型变化时你是否还能稳定交付”。

1)为什么单模型策略正在失效

原因很现实:

- 各家模型能力越来越接近,但长板不同;

- 价格梯度明显,同一任务选错模型会放大成本;

- 延迟、限流、稳定性正在变成一线生产指标;

- 模型迭代太快,全量迁移很容易反复返工。

所以,2026 年更稳的策略不是“只用一个最强模型”,而是:

Sonnet 常驻主力 + Opus 关键兜底 + Gemini/GPT 按任务补位 + 动态路由切换。

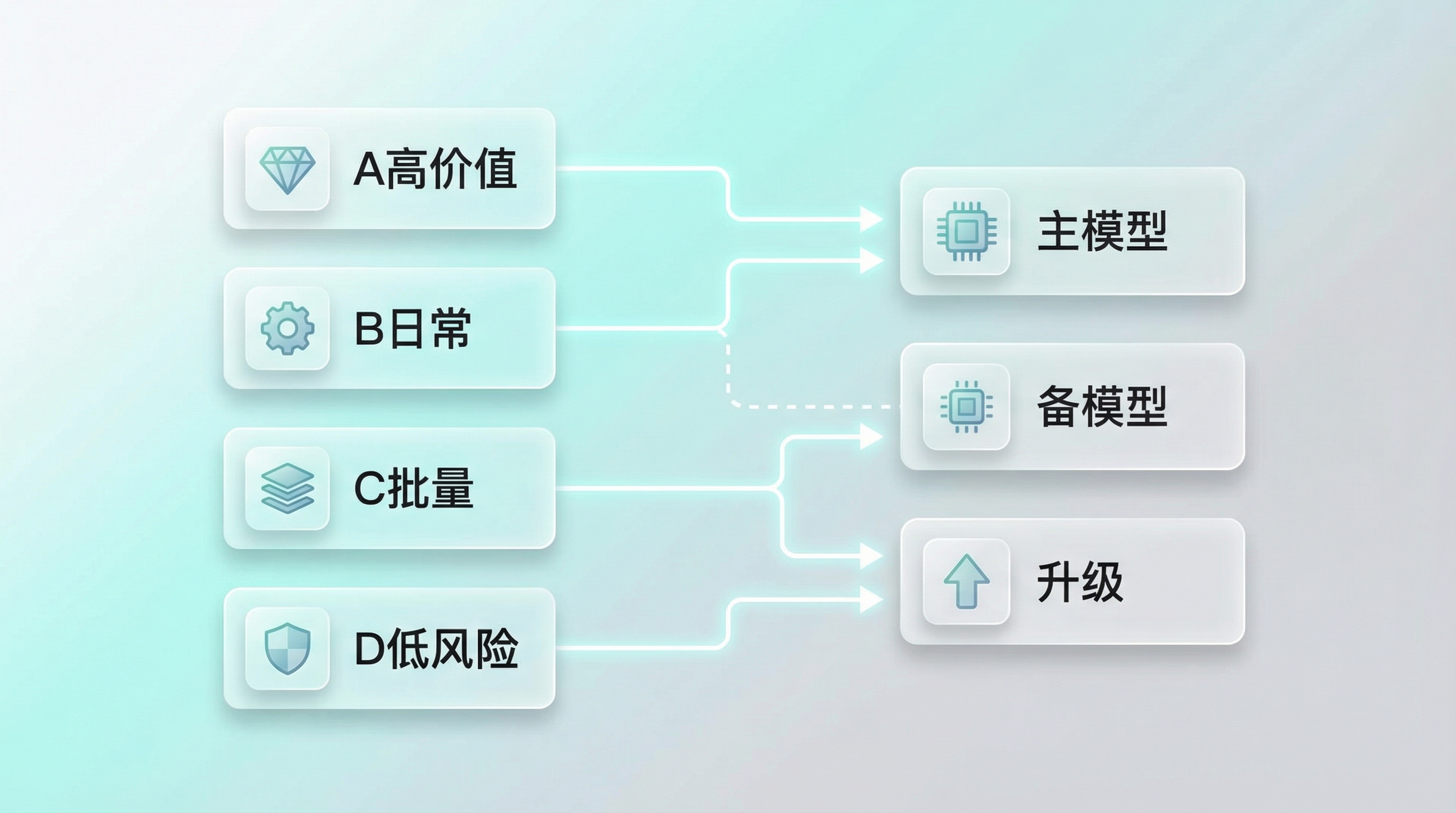

2)先分任务,再选模型

先把团队任务按业务价值分层,而不是先按模型做决策:

- A 类(高价值高风险):核心代码、关键推理、对外关键输出

- B 类(中价值):需求拆解、代码解释、文档初稿

- C 类(流程型):批量摘要、抽取、格式转换

- D 类(低风险重复):分类、润色、模板回复

分层之后再决定分工:

- A 类优先质量与可控性;

- B 类优先效率与稳定;

- C/D 类优先吞吐与成本。

3)可直接落地的分工矩阵

建议用这套默认策略:

- 核心编码/重构(A 类):Opus 级或 Sonnet + 强校验;

- 日常研发辅助(B 类):Sonnet 4.6 作为默认主力,Gemini/GPT 作为并行补位;

- 长文档/跨文件分析(B/C 类):Sonnet 长上下文通道,Gemini 长文档能力作为备选;

- 批量流程任务(C/D 类):轻量模型优先(如 GPT-4o-mini / Gemini Flash),质量不足再升级 Sonnet;

- 外部可见内容(A/B 类):Sonnet + 人审,必要时升级 Opus 或切换 Gemini/GPT 复核。

核心原则只有两条:

- 主模型是默认通道,不是唯一通道;

- 备模型必须提前压测,不能等故障时临时救火。

4)三种路由模式,按业务目标切换

质量优先(核心业务)

高能力模型优先,配测试/规则/人审,适合关键功能与复杂改造。

成本优先(规模化流程)

Sonnet 或轻量模型优先,低置信度任务自动升级,适合后台批处理。

时延优先(交互场景)

首 token 速度优先,超时自动降级,适合 Copilot、客服、实时助手。

一个常见误区是全业务线强行统一模式。正确做法是:不同业务线并行不同路由策略。

5)成本治理别只看 token

很多团队 token 降了,但返工和人审成本上去了。真正该看的是单位任务成本。

建议至少监控 5 个指标:

- 任务成功率(按任务层级)

- 单位任务成本(含返工)

- P95 延迟

- 主备切换率(升级率)

- 人工返工率

如果 Sonnet 已做默认层,但升级率长期偏高,通常不是模型不行,而是任务切分、提示结构或流程设计有问题。

6)没有回滚能力,就没有生产资格

多模型系统必须具备两类“保险丝”:

- 一键降级:快速切回稳定模型;

- 一键回滚:恢复上个已验证路由版本。

再配合灰度发布与故障演练,你的系统才不会在模型波动时被动失控。

模型可以激进迭代,生产系统必须保守治理。

7)30 天落地清单

**第 1 周:**盘点任务并完成 A/B/C/D 分层,定义各类 KPI。 **第 2 周:**建立“主模型 + 备模型”路由,配置切换阈值。 **第 3 周:**上线成本、质量、延迟看板,接入告警。 **第 4 周:**做降级/回滚演练,固化成团队路由规范。

8)具体实现方案(最小可运行 Docker Compose)

下面给一套可以直接跑起来的最小方案:先用 LiteLLM Proxy 做统一路由网关,先跑通“Sonnet 主力 + Opus 兜底 + 轻量模型批处理”,再逐步扩展监控和策略中心。

8.1 准备

在同一目录放置两个文件:

docker-compose.ymllitellm.config.yaml

并在环境中配置:

ANTHROPIC_API_KEYOPENAI_API_KEYGEMINI_API_KEY(用于 Google Gemini 模型)

8.2 docker-compose.yml

|

|

8.3 litellm.config.yaml

|

|

8.4 启动与验证

启动:

|

|

验证(OpenAI 兼容接口):

|

|

8.5 对应本文任务分层的路由映射

- A 类(高价值):直接使用

opus-fallback,或sonnet-default+ 严格人工复核。 - B 类(日常研发):默认

sonnet-default,复杂长文档任务可切换gemini-longctx。 - C/D 类(批量流程):默认

fast-cheap,质量不足再升级到sonnet-default或gemini-longctx。

可先把这套映射写在业务层,再逐步迁移到统一策略中心。

8.6 生产化下一步(建议)

最小版跑通后,再补三件事:

- 监控看板:接 Prometheus/Grafana,重点看成功率、P95、单位任务成本。

- Guardrail:增加 JSON Schema 校验、敏感信息检测、人审闸门。

- 灰度/回滚:上线前做 5%→20%→50% 灰度,异常一键回滚到稳定模型。

结语

这轮 Sonnet 4.6 的价值,不只是“模型更强了”,而是让更多团队第一次具备了系统化降本提效的能力。

真正要升级的不是“追新模型速度”,而是工程方法:

- 用 Sonnet 做稳定主力层;

- 用 Opus 做关键兜底层;

- 用路由、观测、回滚把交付跑稳。

你不需要每次都押中冠军模型。你需要的是:冠军轮换时,你的系统仍然稳定赢。

参考文章与 URL

模型发布与行业动态

- Anthropic:Introducing Claude Opus 4.6 https://www.anthropic.com/news/claude-opus-4-6

- Anthropic:Introducing Claude Sonnet 4.6 https://www.anthropic.com/news/claude-sonnet-4-6

- Google:Gemini Deep Think(研究方向更新) https://deepmind.com/blog/accelerating-mathematical-and-scientific-discovery-with-gemini-deep-think/

- GitHub Changelog:Selected Anthropic and OpenAI models are now deprecated https://github.blog/changelog/2026-02-19-selected-anthropic-and-openai-models-are-now-deprecated/

路由与网关实现

- LiteLLM GitHub 仓库 https://github.com/BerriAI/litellm

- LiteLLM 官方文档 https://docs.litellm.ai/

容器与部署

- Docker Compose 官方文档 https://docs.docker.com/compose/

- Docker Compose file reference https://docs.docker.com/reference/compose-file/