4 月 3 日,Reddit r/ClaudeAI 上出现了一个很奇怪的帖子。

帖子标题叫《Taught Claude to talk like a caveman to use 75% less tokens》——“我教会了 Claude 像穴居人一样说话,Token 消耗减少了 75%"。配图是一张对话截图:Claude 的回复不再是流畅的英文段落,而变成了这样:

“File broken. Need fix. Use class not function. Move logic here.”

8900 赞,412 条评论。一天内登上 r/ClaudeAI 热帖第一。

这不是一个玩笑。它触及了一个很多人忽视的问题:你真的需要 AI 说这么多话吗?

为什么 Token 很重要

在聊实验本身之前,先说一件基本事实:Claude 的费用和速度,都跟 Token 直接挂钩。

输出 Token 是双重成本来源:

- API 用户:按 Token 计费,输出 Token 比输入贵 3-5 倍

- Claude Code 用户:每个对话轮次的 Token 都在消耗订阅额度,越省越多轮

- 速度:输出越少,响应越快,交互体验更流畅

以 Claude Sonnet 为例,输出 Token 的价格约是输入的 5 倍。如果你在用 Claude Code 跑一个长任务,Claude 每次回复都在写大段解释——你其实在花钱买自己不需要的废话。

更关键的是:Claude 的冗余输出远比你想象的多。

当你问 Claude “这段代码有什么问题”,它会回答:

“I’d be happy to help you review this code! Looking at your implementation, I can see there are a few potential issues worth addressing. First, let me examine the overall structure…”

然后才是真正有用的内容。这段开场白占了多少 Token?大约 30-50 个。每次都这样,一天下来,是纯粹的 Token 浪费。

穴居人语法实验

原帖作者 @ffatty 的思路很简单:既然 Claude 擅长遵守 System Prompt,就直接告诉它用最少的词说话。

他使用的 System Prompt 是这样一类指令(原理类似):

|

|

效果是:Claude 的输出从流畅的英文段落,变成了纯粹由关键词和动词构成的"电报语”。

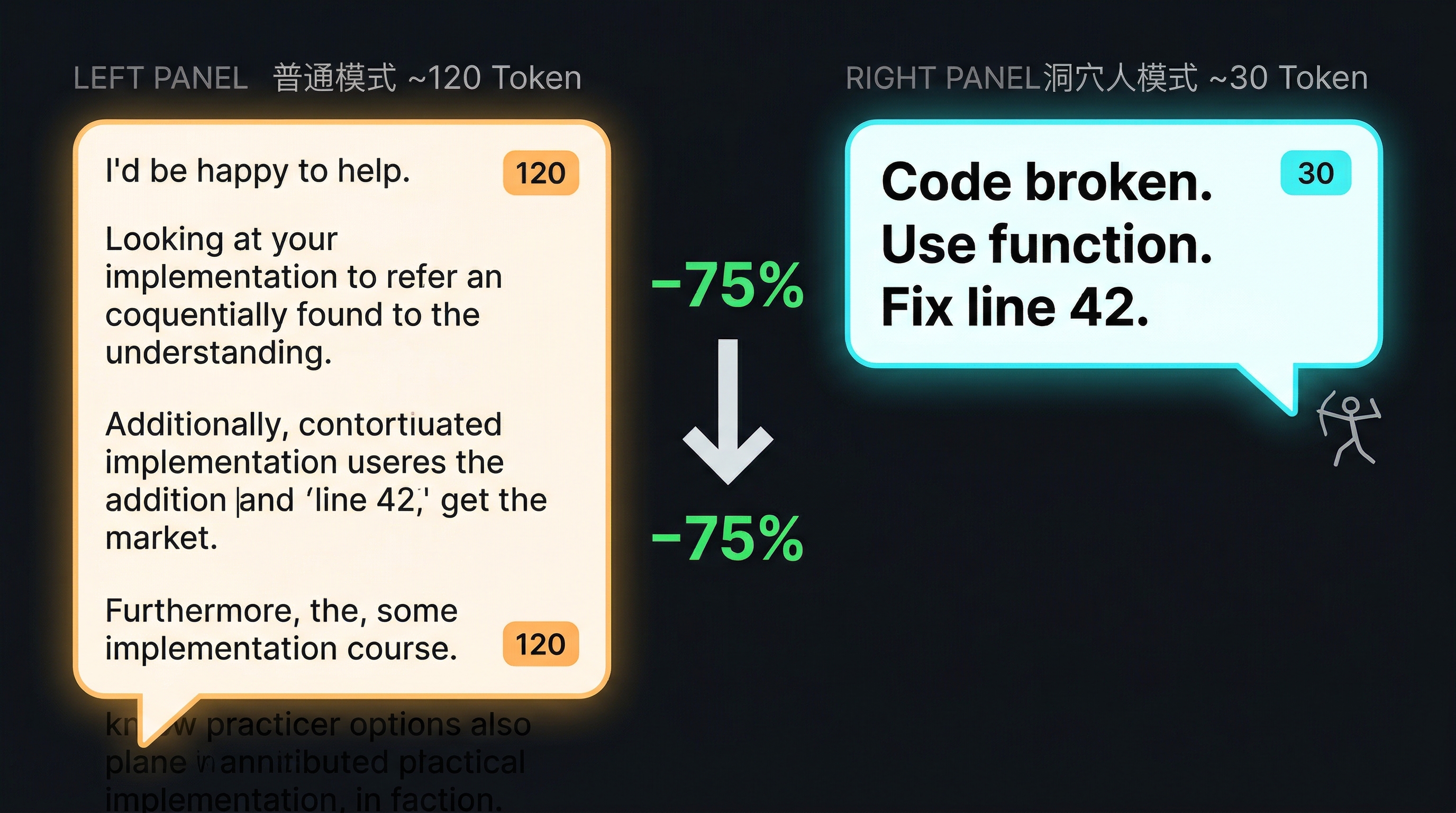

对比示例:

同样的问题——“这段 Python 函数有什么问题?”

普通模式(~120 Token):

“Looking at your Python function, I can identify a few issues that might be causing problems. The main concern is that you’re modifying the list while iterating over it, which can lead to unexpected behavior. Additionally, the variable naming could be clearer, and you might want to add error handling for edge cases…”

穴居人模式(~30 Token):

“List modified during iteration. Bug. Use copy. Rename vars. Add try/except.”

语义完全保留,Token 减少约 75%。

System Prompt 模板(可直接复制)

以下是三个可以直接用的 System Prompt 版本,适合不同场景:

版本一:极简穴居人模式(省 Token 最多)

|

|

适用:Claude Code 任务、快速调试问答、不需要解释的简单指令

版本二:结构化简洁模式(可读性更好)

|

|

适用:代码审查、技术咨询、快速判断

版本三:Claude Code 专用模式

|

|

适用:Claude Code 长任务,减少每轮输出,让 Agent 循环更快

实测:哪些场景省得最多

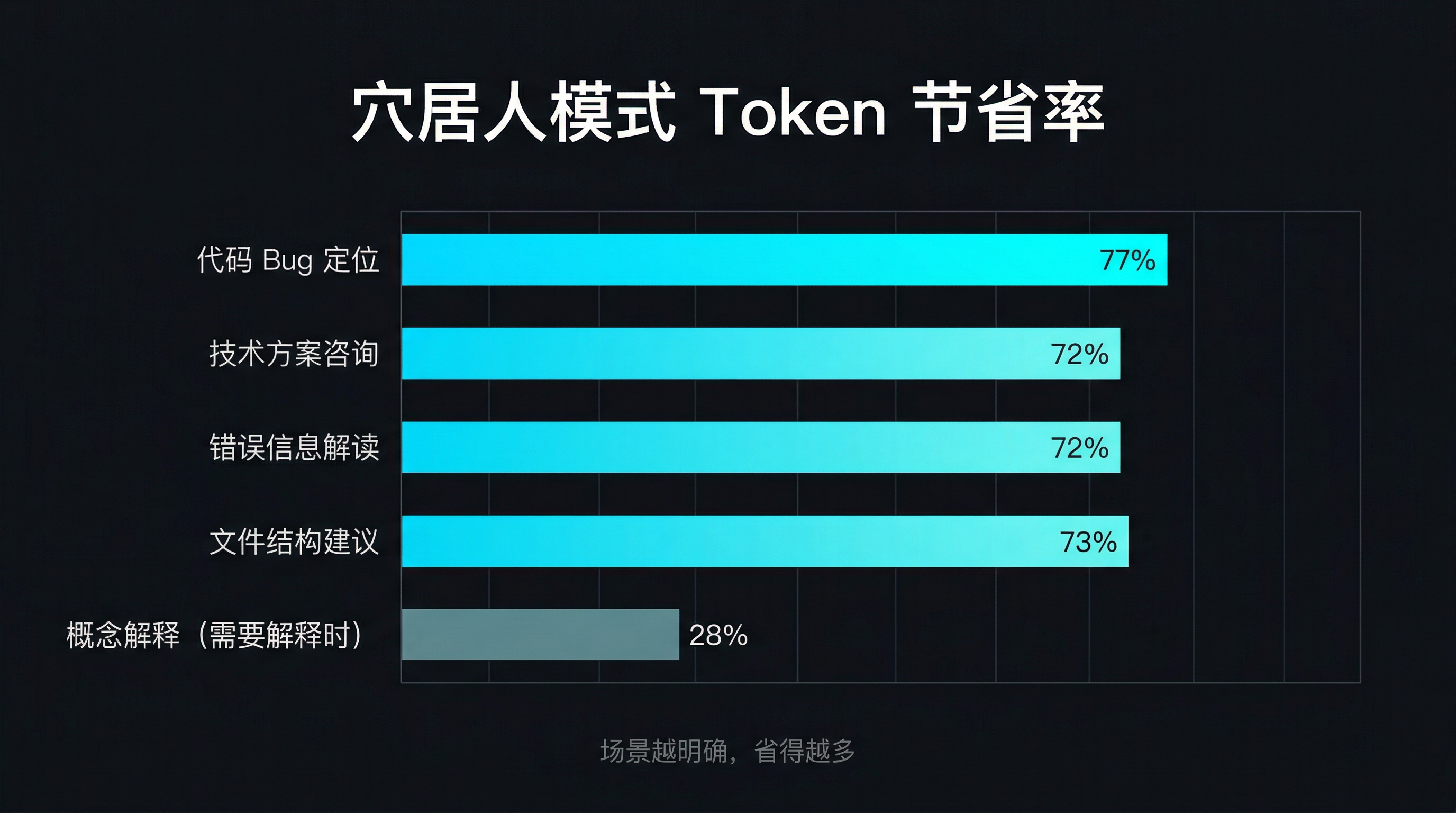

实验帖子下面的评论验证了更多场景,我整理了几个最有代表性的:

| 场景 | 普通模式 Token | 穴居人模式 Token | 节省比例 |

|---|---|---|---|

| 代码 Bug 定位 | ~120 | ~28 | 77% |

| 技术方案咨询 | ~200 | ~55 | 72% |

| 错误信息解读 | ~90 | ~25 | 72% |

| 文件结构建议 | ~150 | ~40 | 73% |

| 概念解释(需要解释时) | ~250 | ~180 | 28% |

规律很明显:越是"我只需要结论"的场景,省得越多。如果你真的需要 Claude 给你解释原理,压缩空间就会变小——这是合理的。

延伸三招:穴居人之外的 Token 优化

穴居人语法只是开始。Reddit 评论区里还有三个被高频点赞的延伸技巧:

1. 强制 JSON 输出

如果你需要的是结构化数据,直接要求 JSON。AI 不会在 JSON 里写废话:

|

|

一个 JSON 对象比一段散文段落少 60-70% 的 Token,而且机器可以直接解析。

2. 上下文裁剪——别把整个文件扔给 Claude

这是 Claude Code 用户最常见的 Token 浪费:把 500 行的文件全部作为上下文,但实际上只有 30 行相关。

更好的做法:

- 在 prompt 里只提供相关代码段,而不是整个文件

- 用

@引用具体函数,而不是整个模块 - 在长对话里,定期开新对话(Claude Code 的

/clear)清除上下文

相关联系:Claude Code 的 /compact 命令会自动压缩对话历史,这也是官方版的"Token 裁剪"。

3. 预设格式,消除协商成本

每次问 Claude “请帮我……",Claude 需要先理解你的格式需求,有时还会先问你确认。这些来回本身就在消耗 Token。

解决方案:在 System Prompt 里直接规定所有输出格式:

|

|

一次性规定好,后续每轮对话都省去格式协商的 Token 开销。

什么时候不该用穴居人模式

有几个场景不适合极简输出:

1. 需要学习的时候 如果你是在学新技术、理解概念,穴居人语法会让 Claude 省掉所有的类比、举例和铺垫——而这些往往是你需要的。这时候正常模式更好。

2. 生成给人看的内容 博客草稿、邮件、文档——这些最终给人读,当然需要完整的语言。

3. 处理模糊需求 如果你的需求本身没想清楚,需要和 Claude 来回探讨,压缩输出会让对话变得难以跟进。先把需求想清楚,再切换到高效模式。

在 Claude Code 里怎么用

Claude Code 支持项目级别的 CLAUDE.md 文件,你可以把穴居人模式写进去,让整个项目的所有 Claude 交互都默认简洁:

在你的项目根目录创建 CLAUDE.md,添加:

|

|

这样不需要每次手动切换模式,全局生效。

还差一步:量化你自己的节省

如果你用的是 Claude API,可以直接在 response 里看 usage.output_tokens,前后对比很直观。

如果用 Claude Pro/Max,目前没有直接的 Token 计数器,但可以用一个间接方法:观察每轮对话的响应速度。同样的问题,穴居人模式的响应通常快 2-3 秒,这就是 Token 减少带来的速度差。

Reddit 那个帖子的评论区里有人说了一句话,我觉得说到点子上了:

“We’ve been training ourselves to expect AI to sound smart by talking a lot. But what we actually need is AI to think well and talk little.”

我们习惯了用"说话多"来判断 AI 是否聪明。但真正有价值的,是把废话都省掉之后剩下的那部分。

穴居人语法是个极端实验,但它证明了一件事:Claude 的智能不在于它说了多少,而在于它知道什么。 你只需要告诉它,少说点就好。

试一下:把这段 System Prompt 复制到你下一次的 Claude 对话里:

|

|

然后问它一个你平时会问的技术问题。看看节省了多少废话——以及答案有没有变差。

大概率没有。

参考来源

- Taught Claude to talk like a caveman to use 75% less tokens — Reddit r/ClaudeAI(⬆️8927,原始实验帖)

- Claude Code 官方文档:CLAUDE.md 配置

- Anthropic API 定价页面(查看 Input/Output Token 价格差异)

- Claude API 使用量统计字段说明(

usage.output_tokens)

扩展阅读

- In the age of vibe coding, trust is the real bottleneck — Fortune:AI 编程的信任危机,与 Token 效率问题一脉相承

- How I use Claude Code (+ my best tips) — Builder.io:Claude Code 实战工作流,含上下文管理技巧

- Building AI Agent Workflows in n8n: The 2026 Complete Guide — DEV Community:自动化场景下 Token 成本控制的实际案例

- Prompt Engineering Is Dead. Long Live Context Engineering — 本站往期文章:从提示词到上下文设计的演进,Token 效率的更深层视角