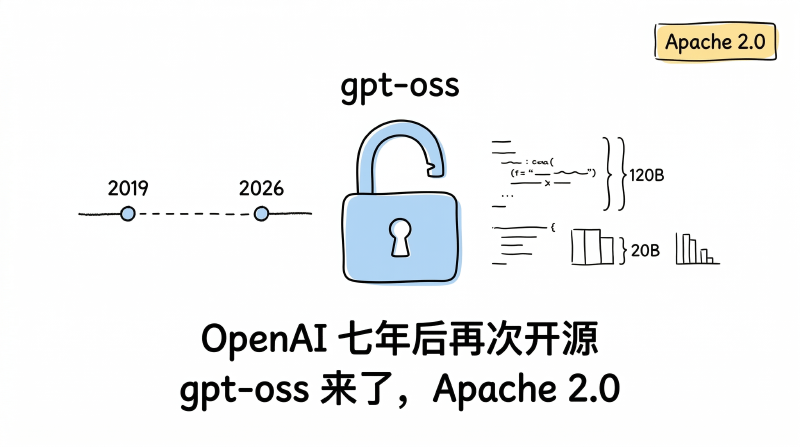

2019年2月,OpenAI 发布了 GPT-2。

那是最后一次。

从那以后,OpenAI 用了整整七年时间,向全世界展示一件事:“Open"这个字,和公司的实际行为没有关系。

GPT-3、GPT-4、GPT-4o、o1、o3……每一代模型,权重锁死,API 付费,商业闭源。“为了防止滥用"的理由说了一遍又一遍,但业界心照不宣:真正的原因是竞争壁垒。

直到这一次。

2026年,OpenAI 发布了 gpt-oss——120B 和 20B 两个版本,Apache 2.0 协议,权重完全开放,可以免费下载、本地运行、商业使用。

七年,一个轮回。

gpt-oss 是什么

先说清楚技术细节。

OpenAI 这次开源了两个模型:

gpt-oss-120b:旗舰版本,参数量 1200 亿,在主流推理基准上的表现接近 o4-mini,能在单张 80GB 显卡(比如 A100 或 H100)上运行。这意味着个人开发者和中小团队,理论上只要有一块服务器 GPU,就能本地跑起来一个"准 o4-mini"水平的模型。

gpt-oss-20b:轻量版本,参数量 200 亿,性能对标 o3-mini,只需 16GB 内存即可运行——这个门槛意味着高端消费级显卡(RTX 4090、RTX 5090)、甚至某些高配 Mac 都能跑起来。

两个版本都:

- 采用 Apache 2.0 协议,商业使用无限制

- 原生支持 MXFP4 量化,降低显存需求

- 已上线 Hugging Face(直接下载权重)

- 已收录 Ollama(

ollama pull gpt-oss即可) - 可部署在 Azure AI Foundry 和 Windows AI Foundry

训练方式上,OpenAI 表示这两个模型使用了与 o3 等前沿系统相同的强化学习技术,具备较强的工具调用能力和推理能力。

它能干什么,性能几何

先泼一盆冷水:120B 接近 o4-mini,不等于就是 o4-mini。

o4-mini 是截至发布时 OpenAI 在 API 上提供的轻量推理模型,已经比较强——但不是最顶级的。GPT-5.4 Pro、GPT-5.4 Thinking 才是当前旗舰,而 gpt-oss 并不在这个层次。

但话说回来,**“接近 o4-mini 的本地模型,免费商用”**这件事本身,已经足够震撼。

做个横向对比:

| 模型 | 参数量 | 显存需求 | 许可证 | 性能对标 |

|---|---|---|---|---|

| gpt-oss-120b | 120B | 80GB | Apache 2.0 | ≈ o4-mini |

| gpt-oss-20b | 20B | 16GB | Apache 2.0 | ≈ o3-mini |

| Meta Llama 4 Scout | 109B | ~80GB | Llama License | 竞争级 |

| DeepSeek V3.2 | 685B (MoE) | 多卡 | MIT | GPT-4级 |

| Qwen3.5-9B | 9B | 8GB | Apache 2.0 | 超越部分120B模型 |

有意思的是,就在几周前,阿里的 Qwen 3.5-9B 在某些 benchmark 上已经超过了 gpt-oss-120B——用 9B 参数干掉了 120B 的对手。这说明 gpt-oss 并非无敌,开源模型军备竞赛仍在激烈进行。

但 OpenAI 的品牌背书,加上真正的 Apache 2.0 无限制商用,给了开发者一个新的选择维度。

为什么偏偏是现在

这才是这件事最值得玩味的部分。

OpenAI 开源 GPT-2 之后选择闭源,当时的官方理由是"GPT-2 太危险了,大规模开源可能被滥用”。这个理由当时就饱受质疑——但无论如何,闭源路线坚持了七年。

那为什么 2026 年要转变?

原因一:DeepSeek 打碎了"开源 = 危险"的神话

2025年初,DeepSeek 把 R1 完整权重开源,瞬间引爆全球开发者社区。它的性能接近 o1,成本却是 OpenAI 的零头,而且完全可以本地运行。

这直接宣告:高性能开源模型根本不是洪水猛兽,而是对用户的礼物。

OpenAI 长期以来用"危险性"为闭源背书的叙事,被 DeepSeek 釜底抽薪了。

原因二:Meta Llama 系列抢走了生态

Meta 的 Llama 系列,从 Llama 2 到 Llama 4,每一代都在建立一个庞大的本地部署生态。Ollama、LM Studio、llama.cpp……整个本地推理工具链,几乎是围绕 Llama 构建起来的。

开发者在 Meta 的生态里跑模型,学工具链,写集成代码——OpenAI 的存在感在这条赛道上几乎为零。

原因三:商业护城河本质上来自 API,不来自权重

OpenAI 真正的商业壁垒,从来不是模型权重,而是:ChatGPT 的产品体验、API 的稳定性和生态、GPT-5.4 系列等前沿模型的持续领先、以及企业合规体系。

开放一个"接近 o4-mini"的模型权重,对 OpenAI 的核心商业利益影响有限——毕竟用户付费买的是最新最强的 GPT-5.4,不是 gpt-oss。

但开放这个权重,能让 OpenAI 重新进入本地部署生态,让开发者在 Ollama 里选模型时看到"gpt-oss"这个名字,重新建立技术品牌认同。

这是一笔代价极低、收益显著的战略账。

对开发者意味着什么

如果你是一线开发者,现在可以做这几件事:

1. 今天就拉下来跑一跑

|

|

2. 完全免费商用,无需担心授权

Apache 2.0 的含义是:可以修改、可以商用、可以集成到产品里、可以闭源分发衍生版本。这是目前最宽松的开源协议之一,比 Meta Llama 的自定义协议更干净。

如果你在做 B 端产品,需要把 AI 能力内嵌进去,又不想每次都调 API 付费、也不想受制于外部服务可用性,gpt-oss 是一个值得认真评估的选项。

3. 作为 fine-tuning 的基础模型

Apache 2.0 允许你在 gpt-oss 基础上 fine-tune,并将 fine-tuned 版本用于商业产品。这对垂直领域 AI 应用开发者是重大利好——用 OpenAI 的底座做专业领域微调,现在合法且免费。

4. 和其他模型做真实对比

不要只看基准测试。在你自己的任务上(代码补全、文档生成、工具调用、推理分析),用 gpt-oss 和 Qwen3.5、DeepSeek、Llama 4 各跑一遍,数据说话。

这是真正的转变,还是表演性开放

说句实话,我持保留态度。

OpenAI 开源的是 gpt-oss-120b——“接近 o4-mini"的能力水平。而当前 OpenAI 自己在用的,是比 o4-mini 强得多的 GPT-5.4。

换句话说:他们开源的是两代前的技术水平,前沿能力依然严格闭源。

这有点像某个厨师,在自家最好的菜已经升级到第五代的时候,把第三代的食谱公开了。足够慷慨,但也足够安全。

更深的问题在于,“开源"这件事对 OpenAI 来说,从来都是工具,不是信仰。GPT-2 开源是为了建立学术社区影响力;七年闭源是为了构建商业护城河;这次开源 gpt-oss,是为了重新进入本地部署生态、对抗 DeepSeek 和 Llama。

每一次选择,都是理性的商业决策。

但对开发者来说,这不重要。重要的是:今天,你可以免费、合法地在本地跑一个 OpenAI 训练的、接近 o4-mini 性能的语言模型了。

不管动机是什么,这是好事。

接下来会怎样

gpt-oss 的发布,是 2026 年开源 LLM 竞争的一个缩影。

现在的局面是:Meta 用 Llama 建生态,Alibaba 用 Qwen 做性能竞争,DeepSeek 用 MoE 架构打成本,OpenAI 用品牌背书重返开源战场,Mistral 专注欧洲合规市场……

开源模型的能力天花板,正在以肉眼可见的速度接近闭源前沿。

对普通开发者来说,这是一个极好的时代:你不再需要依赖任何一家公司的 API,就能在本地运行足以解决大多数实际问题的语言模型。

对 AI 行业来说,这意味着竞争格局正在从"谁的模型最强”,转向"谁的生态最好用、谁的工具链最完善、谁的社区最活跃”。

模型本身,正在成为商品。

七年前,OpenAI 告诉我们,GPT-2 太危险了,不能随便开放。

七年后,他们把同等规模、同等能力的模型,挂在了 Hugging Face 上。

世界还是那个世界,只是竞争格局变了。

引用来源

- Introducing gpt-oss — OpenAI 官方公告

- gpt-oss-120b & gpt-oss-20b Model Card — OpenAI

- GitHub: openai/gpt-oss — 权重仓库

- Welcome GPT OSS — Hugging Face 官方博客

- OpenAI’s open-source model on Azure AI Foundry — Microsoft Azure Blog

- gpt-oss — Ollama Library

- GPT-5.4 vs Claude Opus 4.6: OpenClaw agent real-world test data — Apiyi.com

- 开源小模型的临界点:Qwen 3.5 用 9B 参数打败了 120B 的对手 — 本站往期

扩展阅读

了解 gpt-oss 技术细节

- GPT-OSS Benefits, Configuration & Best Practice — CometAPI

- OpenAI Open Models 官方页面

- Introducing OpenAI’s New Open Models on Databricks — Databricks Blog

开源 LLM 竞争全景

- Best Open Source LLMs: Complete 2026 Guide — Contabo

- Top 5 Local LLM Tools and Models in 2026 — Pinggy

- Open-Source LLMs Compared 2026: 20+ Models — Till Freitag

DeepSeek 如何改变了这场游戏