如果你最近频繁刷到 Claude Code,有两个截然相反的信号几乎同时出现。

一边,是越来越多人把它当成当前最强的 AI 编程工具:能读项目、能改代码、能跑命令、能拆任务,重度用户甚至已经开始拿它替代一部分 IDE 内工作流。

另一边,是抱怨声突然变多了。

有人说它变慢了。 有人说它更吃额度了。 有人说以前那种“我懂你要什么”的流畅感消失了。 还有人直接把这种变化概括成一句很有传播力的话:“我怀念以前的 Claude Code。”

这不是一个小情绪波动。

当 VentureBeat 开始写 Is Anthropic ‘nerfing’ Claude?,当 The Register 开始解释配额争议与 cache TTL 不是一回事,当 X 上的重度用户把“体验退化”说成一种共同体感时,你会发现 Claude Code 正站在一个很有代表性的节点上:

它的能力还在往上走,但它的用户体感,开始分化。

这正是一个 AI 产品进入“口碑拐点”的典型信号。

今天最值得讨论的,不是 Claude Code 还能不能打,而是另一个更关键的问题:

为什么一个公认最强的 AI 编程工具,会在用户越多、场景越重、期待越高之后,开始被更多人吐槽?

这件事的答案,可能比“它最近改了哪些参数”重要得多。

一、用户到底在抱怨什么?

如果你把最近围绕 Claude Code 的不满拆开看,会发现大家抱怨的并不是同一件事,而是几种不同层面的体验同时出了问题。

1. 速度感变差了

这是最容易感知的一层。

用户未必真的知道底层发生了什么,但他们会非常敏感地感觉到:

- 回答变慢了

- thinking 更频繁了

- 一些原本能很快推进的任务,现在更像在“犹豫”

- 明明是类似复杂度的工作,等待时间却更长

对普通聊天产品来说,慢一点可能只是烦。 但对 AI 编程工具来说,慢一点会直接打断心流。

开发者不是坐在那儿等一句优美回答,他们是在改代码、跑测试、切文件、读日志、推进任务。只要等待感变强,工具就不再像“副驾驶”,而更像“堵在你工作流里的瓶颈”。

2. 额度感变差了

这也是最近争议最集中的点。

很多用户的真实感受不是“它不能用”,而是:

它当然还能用,但变得更像一个随时可能吞掉你额度预算的工具。

当一个工具足够强时,用户反而会更愿意把复杂任务都丢给它;但任务越复杂,上下文越长,thinking 越多,工具成本感就越明显。于是用户很容易出现一种心理落差:

- 我明明付费了

- 我也不是在滥用

- 为什么现在会这么快撞到限制?

这种感受,比单纯“涨价”更伤。因为涨价是明确规则,额度焦虑是持续心理负担。

3. 默认行为变“保守”了

还有一类不满更微妙。

一些用户并不是抱怨它慢,而是抱怨它不像以前那么“敢干活”了。

过去那种非常顺滑的感觉,往往来自 Claude Code 会快速理解意图、迅速推进、给人一种“这个助手很懂我”的配合感。现在部分用户觉得,它更倾向于解释、确认、谨慎、延长思考,甚至在某些任务上显得有点“畏手畏脚”。

这种变化不一定意味着模型能力下降。很多时候恰恰相反,可能是产品在试图做更多安全控制、更多默认策略平衡,或者在不同负载下采取了不同调度逻辑。

但对用户来说,感知非常简单:

以前它更像一个会冲在前面的高级助手,现在它更像一个总想先开会的同事。

4. 预期被抬得太高了

还有一个常被忽略的点:

Claude Code 不是在一个“普通工具”的位置上被评价的,它是被当成“可能是当前最强 AI 编程工具”来评价的。

这意味着它承受的不是一般产品标准,而是近乎不公平的高预期:

- 既要足够聪明

- 又要足够快

- 既要深度思考

- 又不能消耗太多额度

- 既要安全谨慎

- 又要像最懂你的搭档一样丝滑

当用户对一个产品的期待接近“全能”,它稍微往任何一边偏一点,都会引发强烈反弹。

所以今天围绕 Claude Code 的争议,本质上不是单点故障,而是四件事叠加:

速度感、额度感、默认行为、超高预期,一起构成了“体感变差”。

二、为什么这不是一个简单的“被 nerf”问题?

很多讨论喜欢用一个很直观的词:nerf。

意思是,产品方是不是把工具“削弱”了。

这个说法传播很快,因为它很符合用户情绪。但如果你想真正理解发生了什么,这个词其实不够精确。

因为在 AI 产品里,用户体验从来不只是模型能力的直接映射。

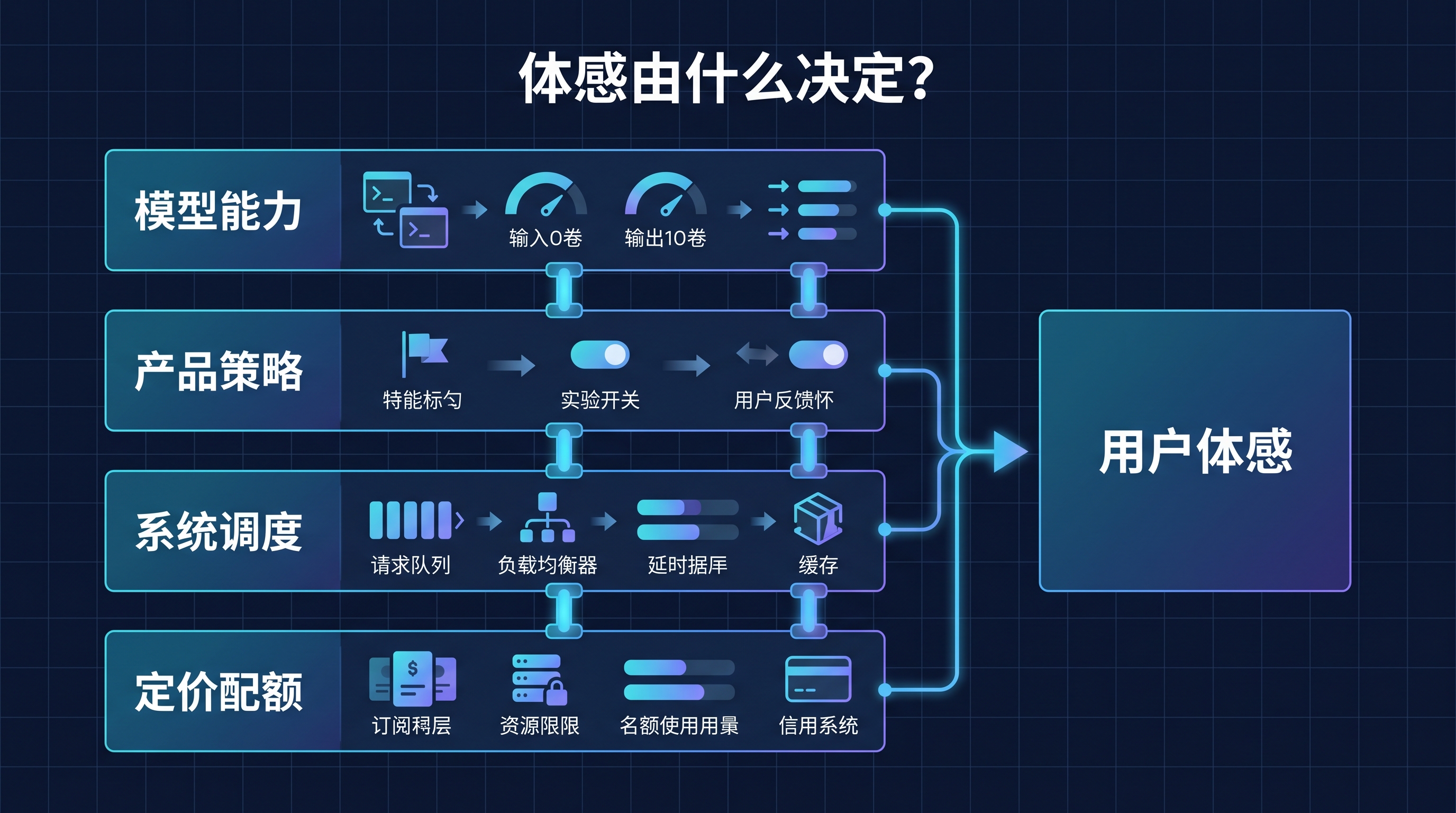

一个工具的最终体感,至少由四层共同决定:

- 模型本身的能力边界

- 产品层的默认策略

- 系统层的容量与调度

- 商业层的定价与配额设计

用户用到的,不是其中任何一层,而是四层叠加后的结果。

也就是说,即便模型本身没变差,用户依然可能明显感觉“没以前好用了”。

1. 模型更强,不等于体感更好

这是很多 AI 产品现在都会遇到的矛盾。

模型越强,往往意味着:

- 更长的上下文处理

- 更复杂的推理链路

- 更高的计算消耗

- 更谨慎的输出控制

这些能力升级,理论上会让结果更好;但在实际使用中,它们也可能带来另一面:

- 更长的等待

- 更高的成本感

- 更明显的不确定性

所以“更强”与“更顺滑”并不总是同方向。

这也是为什么很多用户会怀念早期某个版本的产品体验。不是因为那个版本一定更强,而是因为它在当时的产品结构里,更符合某种具体的使用节奏。

2. AI 产品最难的一层,不是能力,而是稳定性

传统软件里,用户通常只关心功能有没有。

AI 产品里,用户更关心的是:

这个功能是不是能稳定地、可预期地、低焦虑地用。

这其实是更高的要求。

对重度用户来说,最伤体验的不是偶尔答错,而是:

- 今天快,明天慢

- 这个任务表现很好,那个相似任务却突然不稳定

- 有时像专家,有时像实习生

- 有时一口气干完,有时消耗大量额度却推进不多

这种不可预期,会迅速侵蚀信任。

而一旦一个工具被放进真实工作流里,信任比惊艳更重要。

3. “削弱感”很多时候是产品与商业逻辑的摩擦感

还有个现实问题不能回避:

Claude Code 不是研究演示,它是一个真正服务大量用户、需要平衡成本、容量和体验的产品。

这意味着产品团队必须同时面对三件事:

- 尽量把能力做上去

- 尽量控制基础设施压力

- 尽量让付费结构可持续

而这三件事天然互相拉扯。

一旦用户规模扩大、复杂任务增多、大家开始把它当成“主力工作工具”,这种拉扯就会被迅速放大。

所以所谓的“被 nerf”,很多时候并不是一句阴谋论就能解释的事。更接近真相的说法可能是:

Claude Code 已经不再只是一个惊艳 demo,而是进入了真正的产品化摩擦区。

这也是任何顶级 AI 工具迟早都会遇到的阶段。

三、为什么 Claude Code 比别的工具更容易遇到这个口碑拐点?

因为它太接近“主力工具”了。

一个产品如果只是偶尔被拿来试试,用户对它的要求不会那么苛刻。

但 Claude Code 的问题在于,它已经强到让很多人不自觉地提高依赖程度。

你原本可能只是拿它:

- 查一段代码

- 写一个函数

- 解释一个报错

后来慢慢变成:

- 让它理解整个项目

- 让它设计改动方案

- 让它跨文件修改

- 让它跑命令、修测试、补文档

- 甚至让它直接推进一个完整任务

一旦一个工具开始承接这种级别的工作,用户对它的标准就会从“好不好用”升级成“能不能作为生产力基础设施”。

而基础设施一旦出问题,哪怕只是体感层面的不稳定,用户也会高度敏感。

1. 越强的工具,越容易暴露成本问题

弱工具的局限很早就暴露了,用户反而不抱太高期待。

强工具的问题是,它会让用户愿意把越来越重的活交给它。

任务一重,成本就暴露出来了。

于是你会看到一个很典型的现象:

Claude Code 越强,用户越依赖;用户越依赖,就越容易感知到它的配额、速度和稳定性问题。

这不是能力衰退,而是工具进入核心场景后的必然代价。

2. Claude Code 的“高级用户浓度”太高

另一个原因是,它的讨论者里有很多重度开发者、创作者、独立开发者。

这类用户有几个特点:

- 使用频率高

- 任务复杂度高

- 对体感极其敏感

- 很愿意公开分享自己的工作流和不满

也就是说,Claude Code 的舆论环境不是普通消费产品式的“大众抱怨”,而更像一群高强度使用者在做实时口碑压力测试。

这会让任何细微变化都被迅速放大。

3. 它承载了太多“未来工作流想象”

很多人喜欢 Claude Code,不只是因为它现在能干什么,而是因为它代表了一种对未来开发方式的想象:

- AI 不再只是补全工具

- AI 可以进入终端和项目上下文

- AI 可以变成真正的任务执行者

- 开发者未来更像指挥者,而不是纯手工执行者

当一个产品承载这种想象时,用户会天然更希望它“像未来一样顺滑”。

只要现实体验没跟上这种想象,失望感就会特别强。

所以 Claude Code 今天面对的,不只是产品缺陷,而是:

它已经被拿来对标一种未来工作方式。

而凡是代表未来的产品,都会更早遭遇口碑拐点。

四、对 Anthropic 来说,真正的问题已经不是“模型够不够强”

站在产品战略角度看,Claude Code 现在最难的挑战,已经不是把模型再做强一点。

而是另一件更难、也更决定胜负的事:

如何把一个能力顶尖的 AI,变成一个可持续、可预期、专业用户愿意长期依赖的工作工具。

这件事比做一个亮眼 benchmark 难得多。

因为它要求的不是单次惊艳,而是长期稳定。

Anthropic 如果想让 Claude Code 成为真正的工作流入口,至少要同时回答三个问题:

1. 专业用户能不能形成稳定心智?

用户要知道:

- 什么时候适合用它

- 什么时候不该把活全丢给它

- 怎样使用最省额度

- 怎样拆任务最稳

- 在什么场景下它最有优势

如果这些心智不能建立,产品再强,用户也会长期处在“又爱又怕”的状态里。

2. 能不能降低“体感不可预测性”?

最伤口碑的不是贵,也不是慢,而是不稳定。

对职业用户来说,“贵但稳”往往比“便宜但飘”更能接受。

所以 Anthropic 真正需要优化的,未必只是参数,而是让用户重新建立一种感觉:

我知道这个工具今天大概会怎么表现。

3. 能不能给用户更明确的工作流建议?

很多争议其实来自错误使用方式。

AI 编程工具一旦足够强,用户很容易过度依赖,把所有任务都一股脑扔进去,然后在最不合适的场景下感受到最糟糕的体感。

未来真正成熟的产品,不应该只卖能力,还要卖一套更清晰的使用方法论:

- 什么任务适合 deep thinking

- 什么任务该先拆解再执行

- 什么上下文该放进去,什么不该

- 什么时候应该切换工具或切换模型

如果这套方法论缺失,再强的工具也会被用出挫败感。

五、作为重度用户,怎么避免把 Claude Code 用成“吃额度机器”?

如果你今天就已经在重度使用 Claude Code,我反而不建议把注意力全放在“它是不是被削弱了”上。

更有用的问题是:

在当前这个阶段,怎样使用,才能既发挥它的能力,又避免最差体感?

我觉得至少有五个实操原则。

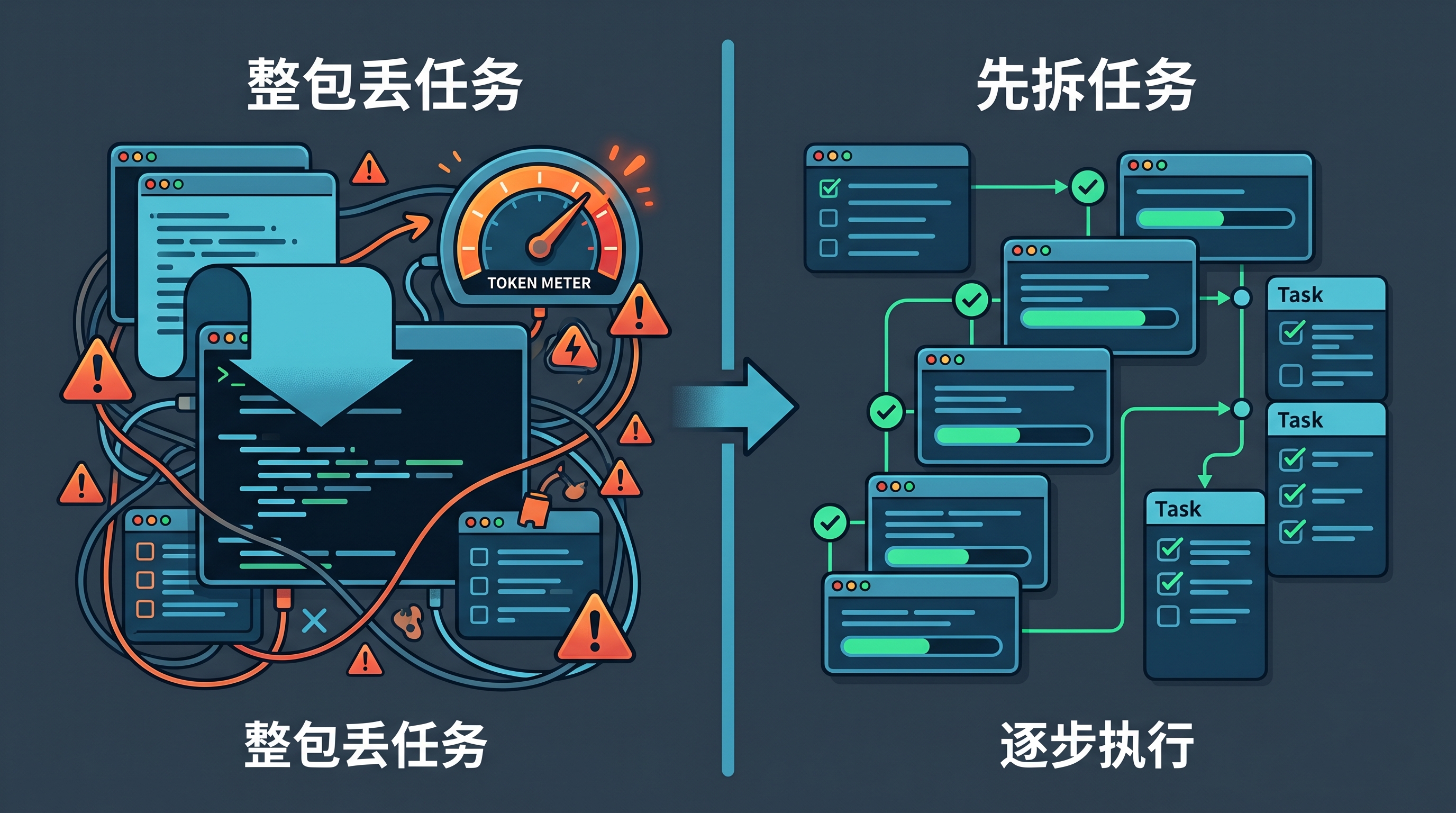

1. 不要把模糊大任务直接整包扔进去

最耗额度、也最容易让体验变差的用法,就是:

- 背景很长

- 目标很模糊

- 约束很多

- 还希望它一步到位

这种任务最容易触发长 thinking、高消耗和低确定性。

更好的方法是先拆:

- 先让它理解问题

- 再让它列方案

- 然后只让它执行一个最小步骤

- 每一步都尽量有明确输出标准

这不是保守,而是让 AI 更接近“可控执行器”。

2. 把 Claude Code 用在高杠杆环节,而不是所有环节

Claude Code 最值钱的地方,往往不是机械生成,而是:

- 快速理解项目结构

- 帮你制定复杂改动路径

- 跨文件定位问题

- 协助推进长任务

- 在陌生代码库里建立全局感

而一些纯重复、低难度、强局部任务,未必需要把最强工具一直挂着。

高杠杆环节用最强工具,整体工作流反而更舒服。

3. 学会管理上下文,不要迷信“一次讲全”

很多人以为把所有背景一次性讲清楚,AI 才会更懂。

但现实里,太长、太杂、层级不清的上下文,往往会让结果更慢、更贵、也更容易偏。

更有效的做法是:

- 每轮只给当前步骤真正需要的信息

- 重要约束重复强调

- 历史信息做摘要,而不是全量堆叠

- 让上下文服务当前任务,而不是展示你掌握了多少信息

好的上下文管理,本质上是在帮 AI 建立工作记忆,而不是给它塞资料堆。

4. 接受“多工具协作”会成为常态

未来一段时间里,最现实的工作方式很可能不是“只用一个工具走天下”,而是:

- 某些任务用 Claude Code

- 某些轻量编辑在 IDE 内完成

- 某些对速度敏感的步骤换别的工具

- 某些低价值任务直接自己做

真正成熟的开发者,不会把工具信仰化,而会把工具工作流化。

5. 把它当成团队成员,而不是魔法按钮

Claude Code 的价值,越来越像一个高能力执行者,而不是一个一次性出奇迹的按钮。

这意味着更好的用法不是“扔个愿望过去”,而是像管理团队一样管理它:

- 任务清晰

- 边界明确

- 节奏合理

- 中间检查

- 及时纠偏

一旦用这种方式看它,很多所谓“体感退化”,其实会变成“我该怎么重新调整协作方式”。

六、Claude Code 的争议,恰恰说明它已经进入主舞台

最后我反而想说一句可能有点反直觉的话:

被集中吐槽,不一定是坏事。

至少对 Claude Code 来说,这说明它已经不再是一个边缘尝鲜工具,而是真正进入了开发者主舞台。

因为只有当一个工具足够重要、足够强、足够被依赖,它的每一次体验波动,才会引发这么高密度的讨论。

没有人会为了一个无关紧要的工具写长帖抱怨它“没以前顺手了”。

大家之所以会争论 Claude Code,是因为它已经足够接近一种新的工作方式:

- 不只是回答问题

- 不只是写几段代码

- 而是开始接管更完整的开发任务

也正因为如此,它面临的评价标准正在升级。

未来 AI 编程工具真正的竞争,不只是模型谁更聪明,而是谁能做到下面这件事:

在真实工作流里,长期、稳定、低焦虑地创造价值。

这比任何一次功能发布都更难。

Claude Code 现在走到的,正是这个最难也最关键的阶段。

所以如果你今天看到越来越多围绕它的争议,我觉得不该只把它理解成“产品出了问题”。

更准确地说,这是一个顶级 AI 工具开始从“惊艳期”进入“基础设施期”的必经过程。

而真正的胜负,往往就是在这个阶段分出来的。

结尾

Claude Code 可能确实没有前一阵子那么“轻盈”了。

但这不一定意味着它在变弱。

更可能意味着,它正在经历一款顶级 AI 工具必然要经历的转折:

从“让人惊艳”,走向“让人长期依赖”。

前者拼的是能力上限,后者拼的是产品稳定性、成本结构、用户心智和工作流设计。

如果 Anthropic 能跨过这一步,Claude Code 就不只是一个强工具,而可能真的会成为很多开发者的默认工作入口。

如果跨不过,用户也会很快学会一件事:再强的模型,如果体感不稳定,也很难成为真正的主力工具。

所以今天围绕 Claude Code 的争议,真正值得关注的,不是谁在吐槽,谁在护航。

而是这场争议背后透露出的更大信号:

AI 编程工具的竞争,已经从“谁更聪明”进入“谁更像基础设施”。

而那,才是下一阶段最残酷的战场。

参考来源

- VentureBeat: Is Anthropic ’nerfing’ Claude? Users increasingly report performance degradation as leaders push back

- The Register: Anthropic: Claude quota drain not caused by cache tweaks

- XDA: Claude Code’s creator keeps sharing tips, and they all made my experience better

- Reddit: i dug through claude code’s leaked source and anthropic’s codebase is absolutely unhinged

- Reddit: Why the majority of vibe coded projects fail

- X: @_colemurray 讨论 Claude Code 体验变化

- X: @GPTaku 的 Claude Code 场景化线程