用 1/13 的参数量,超越了更大的对手——这不是营销话术,是第三方 benchmark 的测试结果。

2026 年 3 月 2 日,阿里 Qwen 团队悄悄发布了一个系列:Qwen 3.5 小模型(0.8B / 2B / 4B / 9B)。

这是他们 16 天内推出的第 9 款模型。发布节奏之快,几乎没引起太多关注——直到测试数据出来。

Qwen3.5-9B 在第三方推理 benchmark 上,超越了 OpenAI 开源的 GPT-OSS-120B。

120B 是 9B 的 13 倍参数。

这不是说 9B 全面碾压 120B,而是说:在某些关键任务上,更小的模型已经达到甚至超越了更大的模型。这是一个信号——开源小模型正在接近一个能力临界点。

一、16 天 9 款:Qwen 3.5 系列完整梳理

先看整张地图,搞清楚 Qwen 3.5 到底有什么:

| 系列 | 参数规模 | 定位 | 适合场景 |

|---|---|---|---|

| Small | 0.8B / 2B | 边缘设备、高吞吐低延迟 | 手机端、嵌入式、实时应用 |

| Small | 4B | 轻量多模态 Agent 基座 | 图文理解、轻量 AI 助手 |

| Small | 9B | 推理+逻辑旗舰 | 代码、数学、复杂问答 |

| Medium | 14B / 32B | 达到 Claude Sonnet 4.5 性能 | 专业级本地部署 |

本文重点说 Small 系列(0.8B-9B),因为这才是大多数人能跑起来的。

全系列完全开源,Hugging Face 和 ModelScope 直接下载,Base 和 Instruct 版本都有。

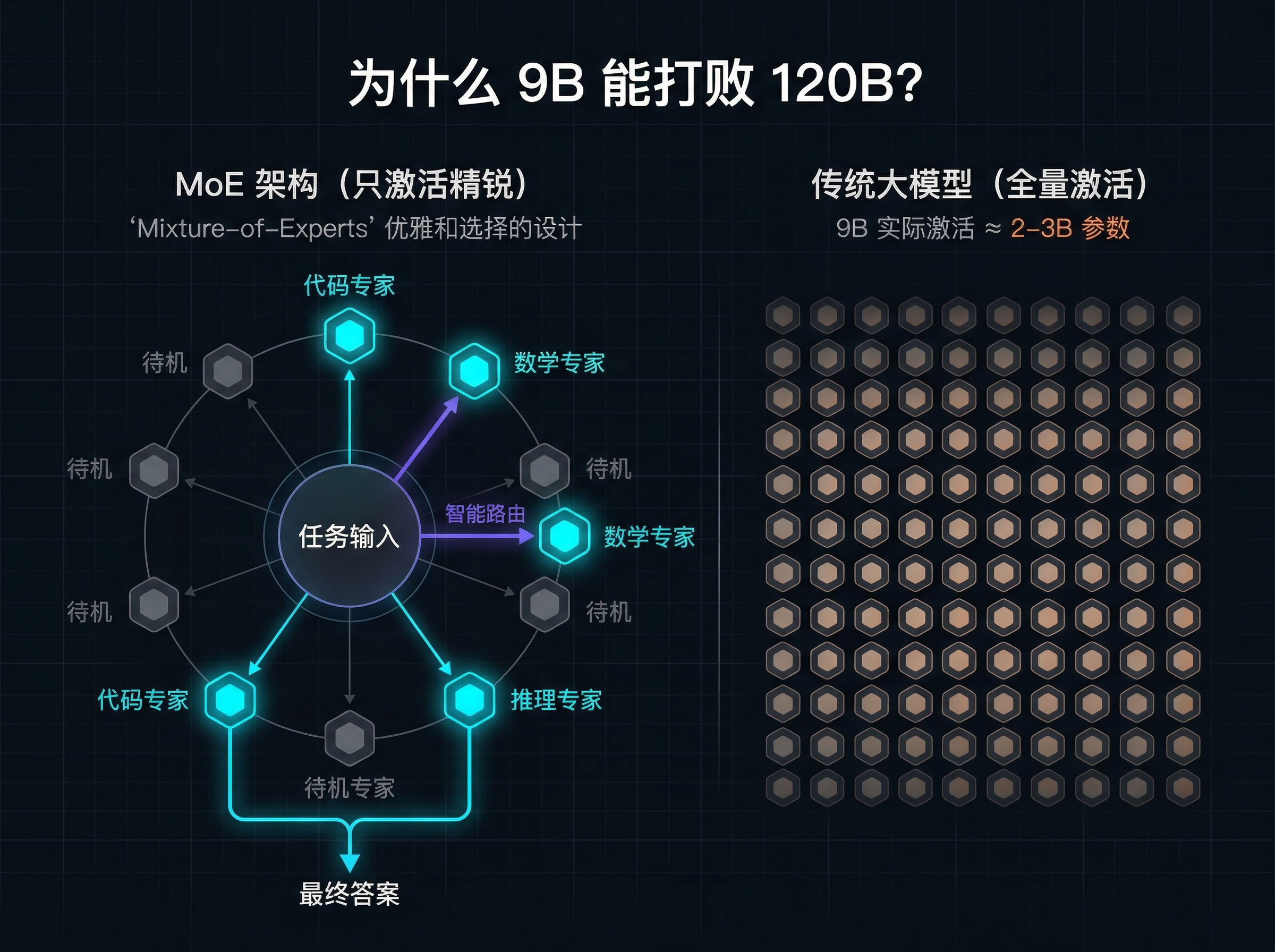

二、9B 为什么能打败 120B?

这是最反直觉的部分,值得说清楚。

传统认知:参数越多 = 能力越强。这在早期是对的,但在 2026 年已经不够准确了。

Qwen 3.5 用的是两个关键技术组合:

① 混合专家架构(MoE)

不是所有参数都同时工作。每次推理只激活一部分"专家"网络处理当前任务。9B 的"实际激活参数"可能只有 2-3B,但针对特定任务选对了专家,效果不差于全量激活的 30B 模型。

这就像一个团队里有 9 个专家,每次只派最合适的 2-3 个上场——比派一个啥都会但哪个都不精通的 120 人大团队,特定任务上更高效。

② 推理时计算(Test-Time Compute)

模型在回答时会"多想几步",通过内部推理链提升答案质量。这个机制让小模型在逻辑推理和数学题上的表现大幅提升,不再只靠参数记忆。

所以 Qwen3.5-9B 超越 GPT-OSS-120B 的领域,主要集中在推理、逻辑、数学——恰恰是这两个技术最能发力的地方。

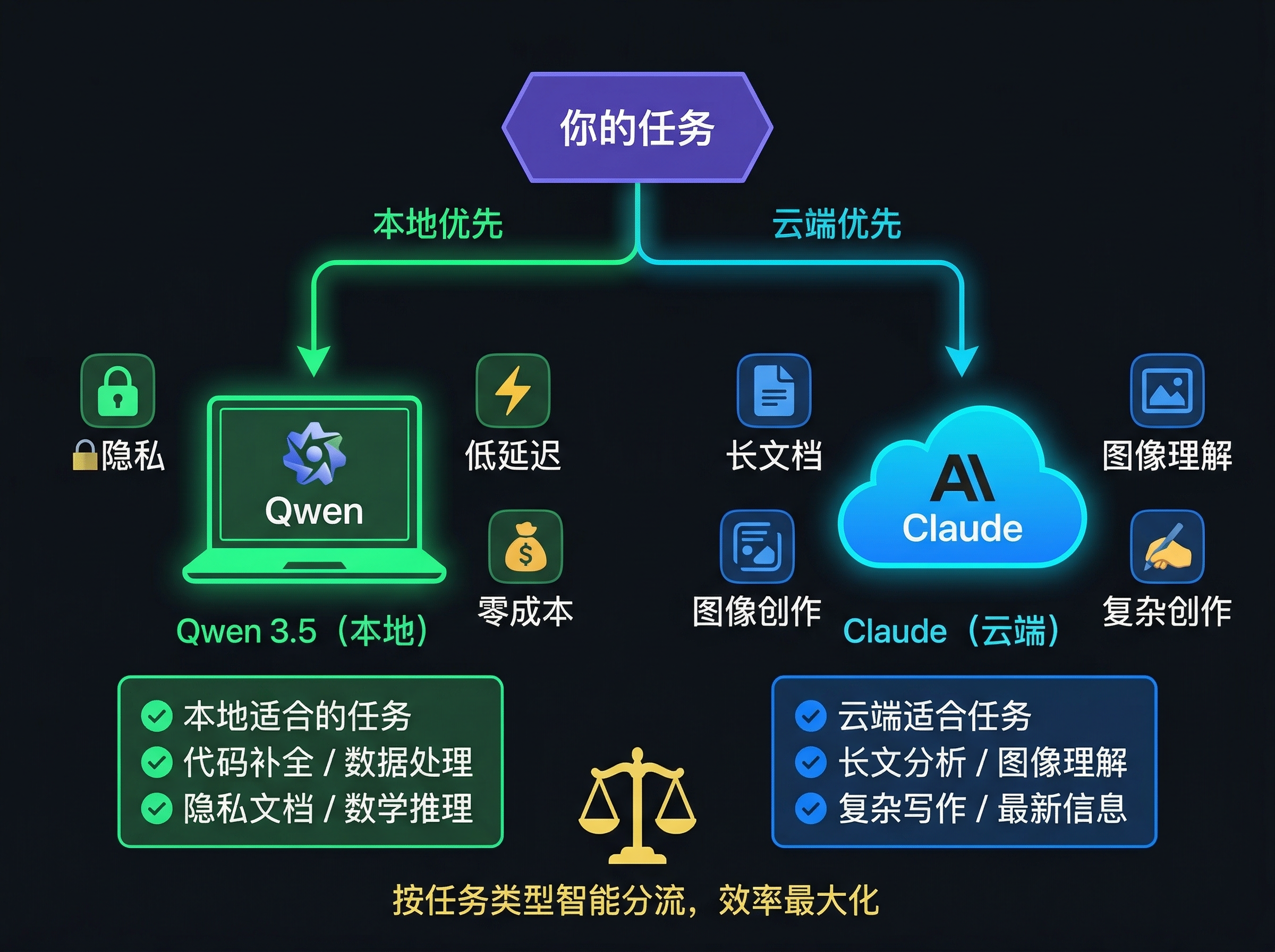

三、什么任务可以放心用本地小模型替代云端?

说清楚了技术,来说实际使用。

✅ 适合用 Qwen3.5-9B 本地替代的场景:

- 代码补全与调试:高频、数据敏感、要求低延迟,本地跑最合适

- 结构化数据处理:JSON 解析、格式转换、数据清洗

- 本地文档问答:不想把内部文档发到云端

- 数学计算与推理:这是 9B 的强项之一

- 批量文本分类/摘要:高吞吐场景,本地成本优势明显

❌ 还是建议用 Claude 的场景:

- 超长文档分析(Claude 有 200K token 上下文,9B 模型一般 32K)

- 复杂多轮创作(Claude 的指令遵循和写作质量仍有差距)

- 图像理解(需要另外部署 VLM,麻烦且效果有差距)

- 需要最新信息(本地模型有知识截止日期,Claude 有工具调用)

一句话原则:重复性、结构化、敏感的任务→本地;创意性、复杂、多模态的任务→Claude。

四、怎么在自己电脑上跑 Qwen 3.5

说点实际的。以 Qwen3.5-9B 为例,两种方式:

方式一:Ollama(推荐新手,3 分钟搞定)

|

|

就这样。Ollama 会自动下载模型(约 6GB),然后在本地起一个 API 服务,兼容 OpenAI 格式。

硬件要求:

- 最低:16GB 内存 + 集成显卡(纯 CPU 推理,较慢)

- 推荐:16GB 内存 + 任意独显(8GB VRAM 以上流畅)

- 最佳:独显 12GB VRAM 以上(RTX 3060 12GB / 4070 以上)

方式二:LM Studio(图形界面,适合不想命令行的用户)

- 下载 LM Studio(免费,支持 Windows/Mac/Linux)

- 搜索

Qwen3.5-9B,点击下载 - 加载模型,直接对话

LM Studio 还内置了 OpenAI 兼容 API 服务,可以直接接入 Cursor、VSCode 插件等工具。

五、和 Claude Sonnet 4.5 对比:差距在哪里,够用吗

坦诚地说:Qwen3.5-9B ≠ Claude Sonnet 4.5,差距是真实存在的。

| 维度 | Qwen3.5-9B(本地) | Claude Sonnet 4.5(云端) |

|---|---|---|

| 代码生成(简单任务) | ★★★★☆ | ★★★★★ |

| 逻辑推理 | ★★★★☆ | ★★★★★ |

| 中文写作质量 | ★★★★☆ | ★★★★★ |

| 上下文长度 | 32K(有限) | 200K(超大) |

| 多模态 | 需另配 VLM | 原生支持 |

| 隐私 | ✅ 完全本地 | ❌ 上传云端 |

| 延迟 | 极低(无网络) | 取决于网络 |

| 费用 | 电费(几乎为零) | 按 token 计费 |

| 更新 | 手动下载新版 | 自动更新 |

Qwen3.5-Medium 系列(14B/32B)才是真正达到 Claude Sonnet 4.5 水平的——但那需要更好的显卡(24GB VRAM),普通用户门槛稍高。

对大多数人来说,Qwen3.5-9B 在日常代码辅助、文档处理、结构化任务上已经够用,不必每次都去调用付费 API。

这意味着什么

回到开头的问题:9B 打败 120B,这件事真正的意义是什么?

不是说参数大的模型已经没用。而是说:“你需要多大的模型"这个问题,现在有了新的答案。

过去,想要高质量的 AI 辅助,你要么付钱用云端 API,要么买一块很贵的显卡跑本地大模型。现在,一块主流显卡 + 一个开源小模型,能覆盖 70% 以上的日常 AI 需求。

本地 AI 的门槛正在快速下降。

Qwen 3.5 只是一个节点,不是终点。接下来的 6 个月,这条线还会继续移动。

快速上手清单

- 确认显卡 VRAM:8GB 以上体验最好

- 安装 Ollama:

ollama run qwen3.5:9b - 或下载 LM Studio,搜索 Qwen3.5

- 试跑代码补全任务,感受一下延迟

- 如果满意,把 Cursor/VSCode 的 AI 后端切换到本地 API