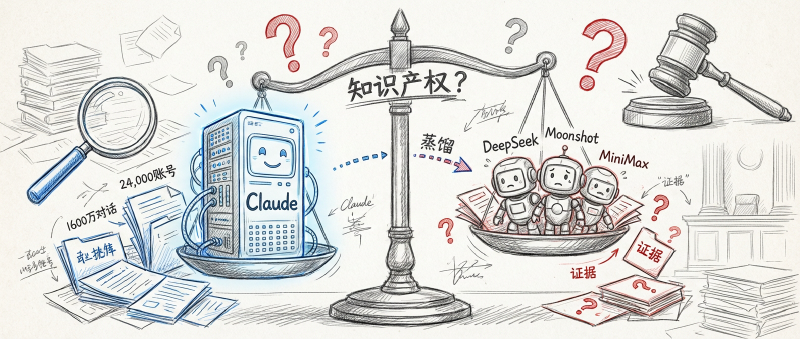

最近AI圈流传着一则劲爆消息:Anthropic公开声称,发现DeepSeek、月之暗面(Moonshot)、MiniMax三家中国AI公司,通过24,000个虚假账号、超过1,600万次对话,大规模"蒸馏"Claude的输出来训练自家模型,并已将相关证据移交有关机构,永久封禁上述账号。

消息一出,国内外科技媒体纷纷转载,评论区充斥着"抓贼了"“坐实了"的定论。

但我想先停下来问几个问题:这件事,真的像Anthropic说的那样确凿吗?

什么是"模型蒸馏”,它算偷吗?

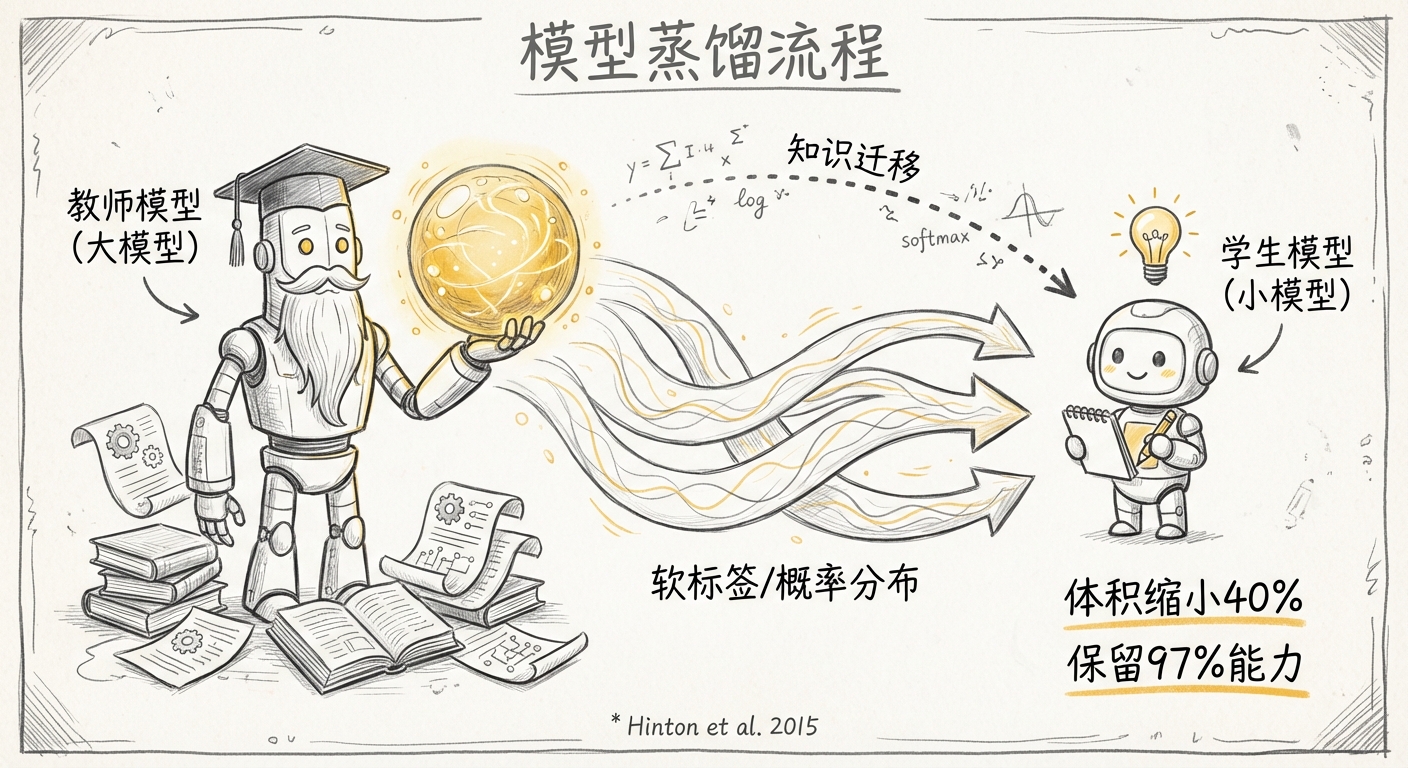

先解释一下技术背景。“模型蒸馏”(Model Distillation)是一种让小模型学习大模型行为的训练方法:用大模型(教师模型)生成大量输出,再用这些输出训练小模型(学生模型),让小模型尽量模仿大模型的回答风格和能力。

这一概念由"深度学习教父"Geoffrey Hinton 与 Google 同事在 2015 年的论文《Distilling the Knowledge in a Neural Network》中正式提出,最初的目的是模型压缩——把笨重的大模型"瘦身",让它能部署到手机或边缘设备上。Hugging Face 的 DistilBERT 就是教科书级案例:体积缩小 40%、速度提升 60%,却保留了 BERT 97% 的语言理解能力。

这个技术本身并不新鲜,也不是什么秘密武器。OpenAI早期的InstructGPT就借鉴了大量人类偏好数据;各家公司都会研究竞品模型的行为模式。问题的关键在于:大规模、系统性地用竞品模型输出作为训练数据,是否构成知识产权侵权?

目前全球没有任何国家的法律对此有明确答案。这是一片真实的灰色地带。

Anthropic的证据到底有多硬?

Anthropic公布的核心数据是:24,000个虚假账号 + 1,600万次对话交换。

这两个数字听起来很确凿,但几个问题值得追问:

一、这些账号如何被认定为"虚假账号"? 是IP地址聚集?注册行为异常?还是有更直接的证据链?Anthropic目前披露的内容并不详细,外界无从独立验证。

二、如何确定这些对话是用于训练数据收集,而不是正常API调用? 大量调用Claude API本身并不违法,很多研究者、开发者都会做大批量测试。仅凭调用量,难以直接推断训练意图。

三、“已移交有关机构"是哪个机构? 这个描述模糊。如果移交的是美国执法机构,那后续会有正式法律程序;如果只是行业自律组织,则约束力有限。迄今没有任何第三方机构公开确认收到或正在调查此事。

别忽视Anthropic的利益动机

在评估任何指控时,我们都应该问:指控方有没有动机夸大或捏造?

Anthropic和DeepSeek是直接竞争对手。过去半年,DeepSeek凭借极低成本、极高性能在全球爆红,对Anthropic的市场份额和融资估值造成了实质性压力。此时发出这样一份"证据确凿"的指控,对Anthropic而言有明显的舆论收益:

- 在技术上抹黑竞争对手(“你的能力是抄来的”)

- 在监管层面给中国AI公司制造麻烦

- 转移外界对"Claude能力是否真的领先"的注意力

这不是说Anthropic在说谎。但利益驱动的指控,需要更高标准的证据支撑,而不是反过来——因为指控者声誉好,就默认指控为真。

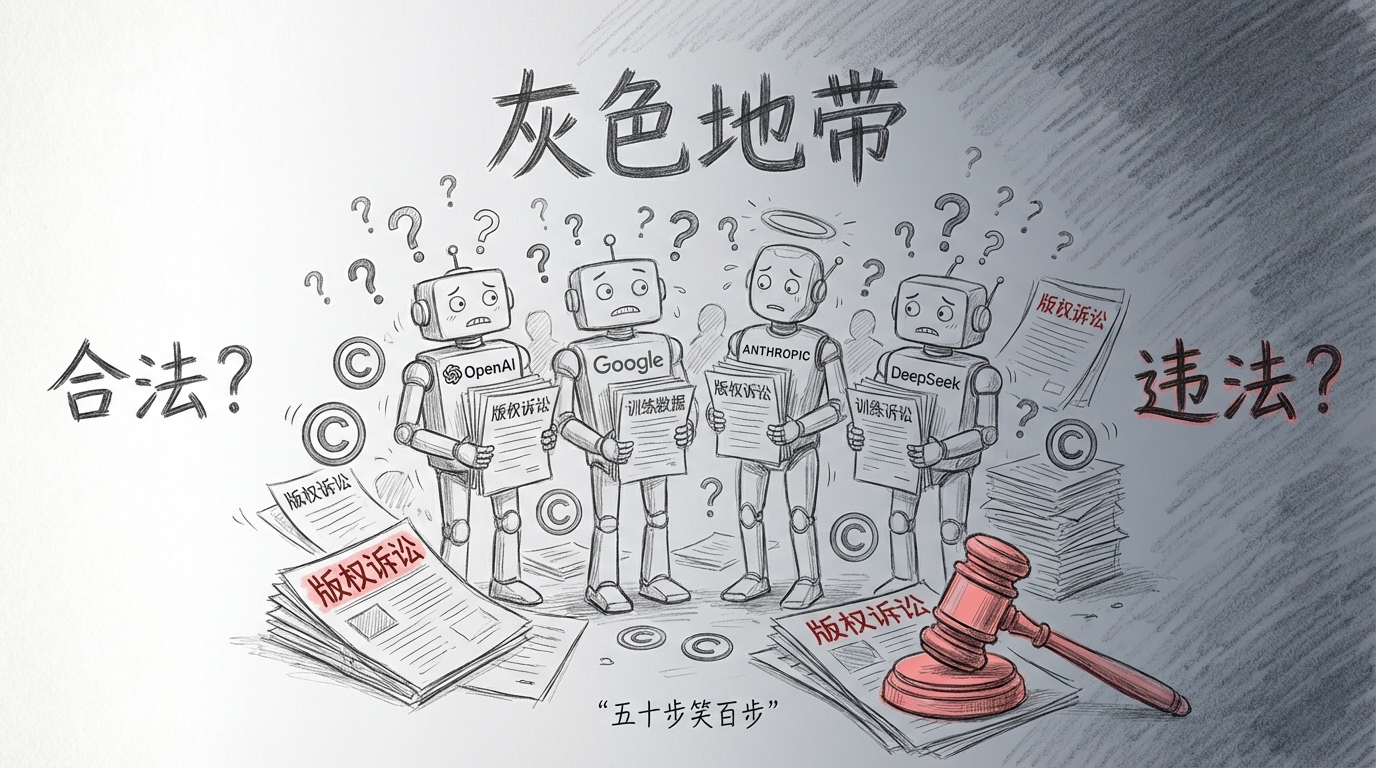

AI行业本身就活在"知识产权灰色地带”

说句可能让人不舒服的话:AI行业几乎没有人是"干净的"。

OpenAI的GPT系列模型,用了大量未经授权爬取的互联网文本,包括数百万作家、记者、程序员的创作,至今仍面临多起版权诉讼。最具代表性的是2023年12月《纽约时报》对 OpenAI 提起的诉讼——这是美国第一家起诉 AI 公司的主流媒体机构。《纽约时报》指控 OpenAI 未经授权用数以百万计的新闻文章训练 ChatGPT,测试还显示 ChatGPT 可以几乎逐字复现其付费报道内容。OpenAI 的核心辩护是援引"合理使用"(fair use)原则。这场官司至今仍在审理中,尚无定论。Google的Gemini同样用了大量受版权保护的内容训练。连Anthropic的Claude,其训练数据来源也从未被完整公开过。

在这个背景下,指责他人"蒸馏"自己模型的输出,多少有些"五十步笑百步"的意味。

当然,这不代表蒸馏行为就可以被接受。只是说,这个行业的知识产权边界,还远没到任何一方可以理直气壮站在道德高地的程度。

DeepSeek们为什么没有激烈反驳?

有人会说:如果是冤枉的,DeepSeek应该出来辟谣啊。

这个逻辑并不成立。公司对竞争对手的单方面指控通常有几种应对方式:公开否认、沉默、或通过法律途径回应。沉默不等于默认,尤其是当指控发生在竞争激烈、政治敏感的跨国商业环境中,法律和PR团队通常会建议谨慎表态,等待更明确的法律框架再行动。

到目前为止,DeepSeek、月之暗面、MiniMax均未就此事发表实质性回应。这是寻常的危机公关策略,不能被解读为"心虚"。

我们真正应该关注什么

这件事最值得持续追踪的,不是"DeepSeek到底有没有蒸馏Claude",而是几个更深层的问题:

1. AI模型输出的版权归属问题。 如果我用Claude生成了1,000万条对话,这些对话的版权是谁的?是Claude(即Anthropic)?是我?还是无主?在法律层面,这个问题目前没有答案。

2. 模型蒸馏是否应该被法律禁止? 还是说,只要不直接复制模型权重,学习行为本身是合法的?这是AI监管领域的核心议题之一。

3. Anthropic的这次指控最终是否会走入法律程序? 如果走,它会成为AI知识产权的开创性判例;如果不走,就说明这更像是一次公关行动。

Anthropic的指控可能是真的,也可能有夸大成分,或者处于某种双方都不完全清白的复杂状态。在独立核实出现之前,我们没有足够的理由选边站队。

保持怀疑,等待证据,这不是"偏袒"任何一方,而是最基本的认知诚实。

原文链接

- Reddit r/ClaudeAI:Anthropic just dropped evidence that DeepSeek, Moonshot and MiniMax were mass-distilling Claude(2295赞 · 402评论)

- Anthropic 官方新闻