DeepMind 这次发了一篇关于 AI Pointer 的文章,表面上是在讲鼠标指针要怎么加 AI,但我读完后反而觉得,它真正戳中的是一个很老的问题:我们和 AI 打交道时,为什么总要先把眼前的东西翻译成一段话?

比如你正在看网页,想让 AI 比较三件商品;或者在 PDF 里看到一段话,想顺手改成邮件里的三条要点;再或者看到地图、图片、视频暂停帧里的某个地方,想知道它是什么、怎么去、能不能预订。

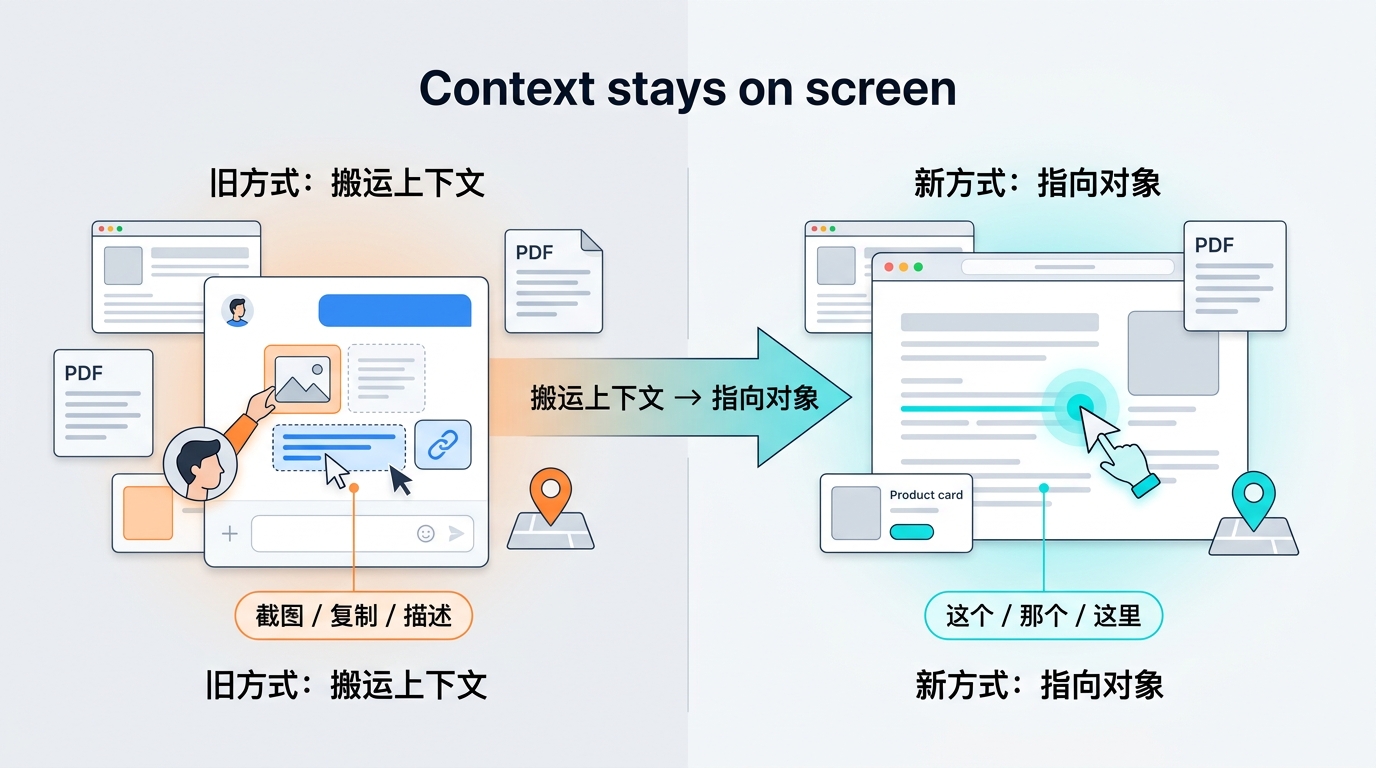

今天的流程通常很笨。截图、复制、粘贴、解释背景,再补一句“我说的是右下角那个”。很多时候,任务本身没那么复杂,复杂的是你要先把屏幕上的上下文搬到聊天框里。

人和人协作不是这样的。我们会指着屏幕说:“这个帮我改一下”“那段总结一下”“这里是什么意思”。对方能理解,不是因为这句话写得多完整,而是因为你们看着同一块屏幕。

DeepMind 在 2026 年 5 月 12 日发布的 AI Pointer 文章 讲的就是这个方向:让鼠标指针不仅知道你停在哪个坐标上,还能理解你指向的是什么,以及它和当前任务有什么关系。

如果这条路走通,Prompt 当然还会存在,但它可能不会再承担那么多本不该由语言承担的工作。

我们不是缺提示词技巧,是缺上下文入口

过去一年,很多人都在学怎么写 Prompt。目标要清楚,背景要完整,约束要明确,输出格式要提前规定。这些技巧有用,我自己也经常这么做。

但越用越会发现,这套方法有一个很大的别扭之处:屏幕上已经有的东西,你还要再说一遍。

网页里已经有商品卡片,你还要写“请比较这三个商品的价格、尺寸和评价”。PDF 里已经有表格,你还要说“请把第二页右下角那个表格转成图”。图片里已经有客厅和沙发,你还要描述“把这张沙发放到那张客厅图里”。

这不是用户懒,也不是用户不会写 Prompt,而是交互方式让用户做了太多上下文搬运。

DeepMind 的说法很直接:典型 AI 工具活在自己的窗口里,用户要把自己的世界拖进去;他们想做相反的事,让 AI 出现在用户本来工作的地方。

我觉得这句话比“AI 鼠标指针”本身更重要。

因为它把 AI 产品从聊天框里往外推了一步。AI 不应该只在一个独立窗口里等你输入,它应该能出现在网页、文档、图片、表格、地图这些任务实际发生的地方。

聊天框时代,我们努力把需求说清楚。AI Pointer 想做的,是先把对象指清楚。

「这个」和「那个」为什么重要

DeepMind 在文章里提到四个原则:保持工作流、边指边说、理解 this 和 that、把像素变成可操作对象。

这些词听起来有点产品文档味,但背后的意思并不复杂。

用户在写邮件时,不应该为了让 AI 总结一段 PDF,又跳进另一个聊天窗口重新描述一遍。用户看着一张图时,也不应该为了改其中一块区域,先写一段很长的文字说明。更自然的方式是指过去,然后说一句短话。

“把这段改短。”

“把这个表转成图。”

“这个地方怎么去?”

“把那张沙发放到这里。”

这些话如果单独拿出来看,几乎没有信息量。但在真实场景里,它们很清楚,因为“这个”和“那个”依赖的不是语言本身,而是共同上下文。

电脑过去只知道鼠标在哪个坐标。AI 加进来之后,它有机会知道那个坐标附近是一段日期、一家餐厅、一块代码、一张商品图,还是视频暂停画面里的某个建筑。

对象一旦被识别出来,动作就接得上了。日期可以变成日程,餐厅可以变成路线或预订,商品可以进入比较表,图片区域可以被编辑,代码块可以被解释或重构。

所以 AI Pointer 不是简单给右键菜单加几个 AI 按钮。它更像是在尝试把屏幕上的东西重新语义化,让 AI 能看懂用户正在处理的对象。

这一步做成之后,用户就不必每次都先把上下文从界面里挖出来,再塞给 AI。

从“听你描述”到“看你指向”

Prompt 是把意图压缩成语言。

Pointer 是把意图绑定到对象。

两者差别很大。

你说“帮我总结一下这份报告”,AI 还要继续问:哪份报告?哪一部分?给谁看?要多长?用什么语气?

但如果你在报告里选中一段,直接说“改成给老板看的版本”,范围已经确定了一半。AI 要做的不是猜对象,而是处理对象。

网页购物是一个很直观的例子。现在你想让 AI 比较几个商品,往往要复制链接,或者截图,再解释你关心价格、尺寸、评价还是售后。理想状态下,你只要选中几个商品,说“帮我看哪个适合小户型客厅”。页面上已经有图片、尺寸、价格、评价,AI 不需要你重新打一遍。

地图也是一样。DeepMind 举了一个例子:指向一张建筑图片,说 “Show me directions”。如果系统已经知道你指的是哪个建筑,后面就不是聊天了,而是路线规划。

图片编辑可能会更明显。Google 同一天还宣布 Gemini in Chrome on Android 和 auto browse,里面提到用户可以在浏览器里直接修改网页图片,比如把房源图改成带现代客厅家具的样子。放到 AI Pointer 的思路里,这类操作会变成:指向图片里的区域,说“这里换成这张沙发”。

语言还在,但不用再扛起全部上下文。

这就是我觉得它值得写的原因。

Google 为什么有机会把这事做大

AI Pointer 不是单独出现的。

同一天,Google 还发布了 Gemini in Chrome with auto browse 和 Googlebook。前者把 Gemini 放进 Android 版 Chrome,支持网页总结、连接 Google 应用、自动处理停车预订和订单修改。后者提出 Magic Pointer,把 Gemini 的上下文建议放到 Googlebook 的光标上。

三件事放在一起看,就不是实验室里展示一个聪明鼠标那么简单了。

Google 想把“指向式 AI”接进浏览器、移动端和笔记本。

这正好踩在 Google 的长处上。它有 Chrome,知道用户正在看什么网页;有 Android,知道移动场景;有 Gmail、Calendar、Keep、Maps,可以把屏幕对象接到真实动作;有 Gemini 处理多模态上下文;再加上 Googlebook 这种硬件入口,指针就不只是网页里的一个功能,而可能变成系统层能力。

很多 AI 公司都能做模型,但不是每家公司都站在用户工作流发生的地方。

这也是 AI Pointer 对 Microsoft、Apple、浏览器厂商、IDE 厂商都有启发的原因。如果 AI 从聊天框走向屏幕上的任意对象,最值钱的位置可能就不是单独的 AI 应用,而是操作系统、浏览器、办公套件、设计工具、开发环境这些原本就承载任务的地方。

谁离用户正在处理的对象更近,谁就更容易成为下一代 AI 入口。

Agent 的起点可能会变

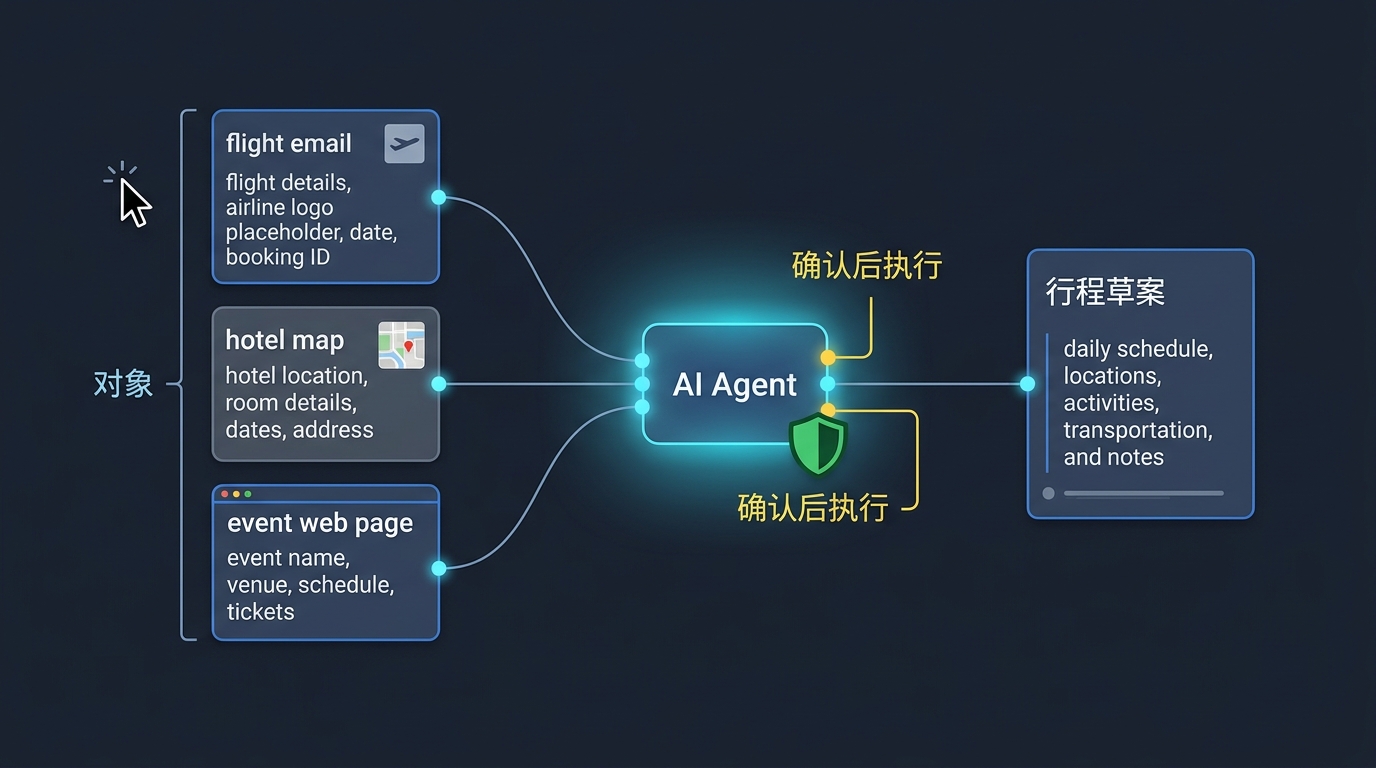

现在很多人谈 Agent,会先想到工具调用、浏览器自动化、多步骤规划。这些都对,但从用户体验看,还有一个更早的问题:任务从哪里开始?

在聊天框里,任务从一句话开始。

在 AI Pointer 里,任务可以从一个对象开始。

用户不一定要先说“请帮我规划一次出行”。他可以指向邮件里的航班信息、地图上的酒店、网页上的活动页面,然后说“整理成行程”。Agent 接到的不是一个空泛命令,而是一组已经绑定上下文的对象。

这会让很多 Agent 任务更容易启动,也更容易出错。

Google 在 Chrome auto browse 的说明里特意提到,涉及购买、发帖等敏感动作时,会要求用户确认。这个细节不能忽略。指向式交互越顺滑,用户越容易把上下文交给 AI;一旦接上真实动作,权限边界就必须非常清楚。

AI 可以读懂你指向的是一张订单,但是否修改订单、是否付款、是否发送邮件,必须有确认。否则,交互越自然,风险越不容易被察觉。

所以 AI Pointer 后面真正难的,不只是识别屏幕上的东西。它还要回答几个更麻烦的问题:AI 看到了什么,用户知不知道;哪些动作可以直接做,哪些必须确认;识别错了怎么撤销;不同应用之间的权限怎么隔离。

这些问题解决不好,它就是一个炫技功能。解决得好,它才可能成为系统级入口。

对做产品和写内容的人有什么启发

我不建议把 AI Pointer 理解成“鼠标加 AI”。那样太窄了。

更准确地说,AI 正在从语言入口扩展到对象入口。

过去我们教别人用 AI,重点是怎么描述需求。以后可能还要教另一件事:怎么组织界面里的对象,让 AI 能看得懂、选得准、动得起来。

这对产品设计影响很大。

如果一个页面全是无法识别的图片、混乱的卡片、没有语义结构的 canvas,AI 很难知道用户指向的到底是什么。反过来,如果页面对象有清晰层级、元数据和可操作状态,AI 就更容易把它们变成动作。

以前我们说 UI 要让人看得懂。现在可能还要加一句:也要让 AI 解析得出。

这会影响网页结构、组件命名、可访问性、表单设计、文档格式,也会影响内容创作。一篇文章、一张图、一个产品页面,如果天然适合被 AI 指向、引用和操作,它的价值会更高。

这件事现在看起来还早,但方向已经露出来了。

Prompt 不会消失,只是不用什么都靠它

我不觉得 AI Pointer 会让 Prompt 消失。

复杂任务还是需要语言。你仍然要告诉 AI 目标、偏好、约束、判断标准。只是 Prompt 不必继续承担所有上下文搬运工作。

更自然的交互大概会是这样:你先指向对象,用一句短话表达意图;AI 读取当前界面的语义上下文,给出动作;如果动作有风险,再向你确认。

这比今天复制一堆材料、写一段长 Prompt、等 AI 猜你到底指什么,要接近真实协作得多。

所以 AI Pointer 的意义不在于鼠标指针变酷了,而在于它提醒我们:AI 交互的下一步,未必是让每个人都成为提示词专家,也可能是让 AI 更像一个站在旁边、和你看着同一块屏幕的协作者。

当 AI 能理解“这个”和“那个”,人机协作才开始有一点像人和人协作。

提示词之后,下一个交互范式也许就是:指给 AI 看。