OpenAI 发布 GPT-5.5 后,很多人的第一反应大概还是老三样:

它比 GPT-5.4 强多少?

它比 Claude Opus 4.7 强多少?

它写代码到底有没有更猛?

这些问题当然重要,但我觉得这次真正值得看的,不是模型排名。

GPT-5.5 最关键的信号,是 OpenAI 开始很明确地把模型从「聊天机器人」往「干活系统」上推。

官方介绍里有几个词特别扎眼:real work、agents、Codex、use tools、check its work、carry tasks through to completion。

翻译得直白一点就是:

以后模型不只是陪你聊天、帮你生成一段内容,而是要开始接任务、用工具、检查结果,并尽量把事情做完。

这件事比「又聪明了一点」重要得多。

来源:OpenAI 官方公告,2026年4月23日

聊天窗口已经不够用了

过去两年,我们对 AI 的默认想象基本都是一个聊天框。

你问一句,它答一句。

你贴一段代码,它改一段代码。

你给一堆材料,它总结一篇文档。

这已经很好用了,但它有一个明显边界:它大多数时候只是在完成「表达」,不是完成「事务」。

比如你让 AI 帮你做一个竞品分析。

普通聊天模型通常会给你:

- 一个分析框架;

- 几个竞品维度;

- 一段看起来挺像样的总结;

- 最后再提醒你「可以进一步结合实际业务情况」。

然后事情就停在那里。

真正的工作不是这样。

真实的竞品分析可能包括:

- 去网页抓资料;

- 整理多个产品的功能差异;

- 放进表格;

- 生成截图或引用链接;

- 写成内部汇报文档;

- 检查有没有遗漏;

- 最后发给某个团队成员。

也就是说,真实工作天然是跨工具、跨上下文、跨步骤的。

聊天框只能解决其中一小段。

OpenAI 这次讲 GPT-5.5,不断强调「复杂目标」「工具使用」「自我检查」「完成任务」,其实就是在说:模型不能一直停留在聊天框里。

它要进入工作流。

GPT-5.5 的重点不是更会说,而是更像执行器

过去我们评价一个模型,经常看这些东西:

- 回答是否准确;

- 推理是否更强;

- 写代码是否更快;

- 幻觉是否更少;

- 上下文是否更长。

这些指标当然还重要。

但如果模型要真的进入工作场景,评价标准会变得更苛刻。

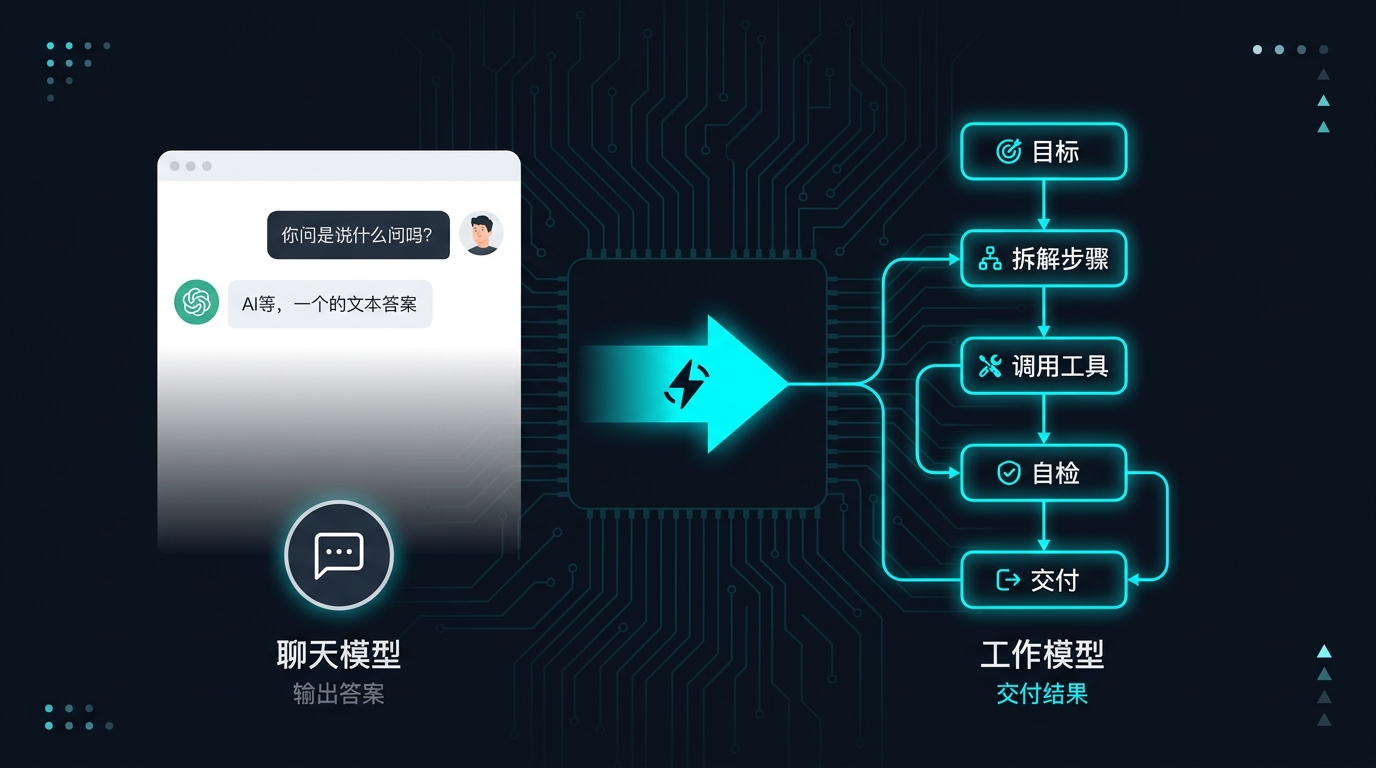

你不能只问它「答得好不好」,你要问:

- 它能不能理解一个不那么清晰的真实目标;

- 它能不能自己拆成几个步骤;

- 它能不能知道什么时候该调用工具;

- 它能不能发现自己做错了;

- 它能不能把任务从开头推进到结尾。

这就是聊天模型和工作模型的区别。

聊天模型输出答案。

工作模型交付结果。

这也是为什么我觉得 GPT-5.5 的发布语境很重要。OpenAI 没有只说「我们做了一个更聪明的模型」,而是在反复暗示:这个模型是为 real work 准备的。

real work 这个词很微妙。

它不是 demo。

不是 benchmark。

不是一次漂亮的回答。

它指的是那些真实、琐碎、跨系统、需要收尾的任务。

为什么 Codex 这次很关键?

GPT-5.5 进入 Codex,不只是「代码能力增强」这么简单。

AI 编程是观察这轮模型变化最好的窗口,因为写代码天然有闭环。

代码不是写完就完了。

它要能跑。

测试要能过。

Bug 要能复现。

改动要能 review。

上线后还不能炸。

这比写一篇看似流畅的文章难得多。

一个真正能参与编程的 AI,不应该只是补全几行代码,而是要能完成一整段工程任务:

- 读懂需求;

- 找到相关文件;

- 理解现有实现;

- 改代码;

- 跑测试;

- 根据报错继续修;

- 最后把改动解释清楚。

这也是为什么 Claude Code、Cursor、Codex 这些工具会成为大模型竞争的主战场。

它们比的不是谁更会聊天,而是谁更接近一个「能干活的同事」。

以前 AI 编程的主语还是人:

我写代码,AI 辅助我。

现在主语正在慢慢变化:

我设定目标,AI 负责推进一段可验证的工程任务。

这一步变化非常大。

它意味着程序员的工作不是简单变轻了,而是工作重心变了。

你不一定少操心,但你操心的东西不一样了。

Workspace Agents 是另一半拼图

和 GPT-5.5 一起值得看的,还有 OpenAI 推的 Workspace Agents。

这个名字里最关键的词不是 agents,而是 workspace。

它说明 OpenAI 想做的不是再给你一个更聪明的私人聊天助手,而是让 AI 进入团队协作环境。

来源:OpenAI Workspace Agents 官方公告,2026年4月22日

这件事的想象空间很大。

一个销售团队可以有线索筛选 Agent。

一个运营团队可以有用户反馈归类 Agent。

一个产品团队可以有竞品分析 Agent。

一个工程团队可以有代码审查 Agent。

一个内容团队可以有资料整理和初稿生成 Agent。

这些东西和普通 ChatGPT 的差别在于:它们不是一次性问答,而是可复用的工作节点。

你不再是每次打开聊天框,重新解释背景、重新贴资料、重新说一遍格式要求。

而是把某类任务沉淀成一个可以反复调用的 Agent。

这其实更接近公司里的岗位分工。

不是因为 AI 像人,而是因为它开始占据工作流里的固定位置。

国内用户真正该关心什么?

很多国内用户看 GPT-5.5,第一反应可能是:

能不能用?

贵不贵?

有没有平替?

比 Claude 好不好?

这些都很实际。

但如果只盯着这些,就容易错过更大的变化。

OpenAI 这次其实是在给下一代 AI 产品定调:以后大家拼的不会只是「模型回答质量」,而是谁能更好地完成工作闭环。

我觉得接下来 AI 工具会越来越围绕三个问题竞争。

第一,能不能接工具

不能接工具的 AI,只能给建议。

能接工具的 AI,才可能完成任务。

这也是为什么 MCP、浏览器控制、代码执行、文件系统权限、自动化脚本这些东西突然变得重要。

过去大家卷提示词。

以后大家会卷工具链。

提示词决定你怎么问。

工具链决定 AI 能做什么。

第二,能不能保持上下文

真实工作不是一次性问答。

一个需求可能持续几小时。

一个项目可能持续几周。

一套系统可能有很多历史包袱。

如果 AI 每次都要你重新解释背景,它就是一个临时顾问。

如果 AI 能持续理解项目结构、记住约束、追踪任务状态,它才像一个协作者。

这也是为什么 Claude Code 这类工具会强调项目上下文,为什么 Workspace Agents 会强调团队共享。

上下文不是附加功能,而是工作型 AI 的地基。

第三,能不能自检

这是从玩具到工具的分界线。

很多 AI demo 看起来很惊艳,但一进真实工作就露馅,原因不是它不会生成,而是它不会检查。

代码有没有跑?

引用有没有来源?

数据有没有算错?

文件有没有放对?

格式有没有符合要求?

有没有误删东西?

这些才是真正消耗人的地方。

一个模型如果不能自检,就不能真正交付。

它最多只是一个很会写初稿的实习生。

AI 越强,为什么人反而更累?

最近很多开发者有一种很矛盾的感受:

AI 编程工具变强了,但自己好像没有想象中那么轻松。

原因很简单。

AI 只能写几行代码时,你还是主要执行者。

AI 开始能接任务时,你就变成了调度者和审查者。

这不是更轻松的工作,而是另一种工作。

你要学会:

- 把需求拆成适合 AI 执行的任务;

- 给它足够但不过量的上下文;

- 控制它能访问什么;

- 判断它什么时候跑偏;

- 审查它交付的结果;

- 必要时把它拉回正确方向。

所以很多人会发现:AI 不是把工程师变成了甩手掌柜,而是把工程师推向了更像技术负责人、产品经理、架构师混合体的位置。

这也是 GPT-5.5 这种模型值得关注的原因。

它越像执行器,人就越需要学会管理执行器。

真正的变化,是「任务接口」取代「聊天接口」

我越来越觉得,聊天框只是大模型的早期形态。

它很自然,因为人类最容易通过对话理解 AI。

但长期看,AI 的主入口未必是聊天框。

在编程里,它可能是 IDE 和终端。

在办公里,它可能是文档、表格和项目管理工具。

在企业里,它可能是工单、CRM、知识库和自动化流程。

在个人知识管理里,它可能是 Obsidian、NotebookLM、浏览器和本地文件系统。

聊天框不会消失,但它会从「主界面」变成「控制台」。

你在里面下达目标、确认方向、处理异常。

真正的执行发生在后面的工具链里。

这才是 GPT-5.5、Codex、Workspace Agents 放在一起看的意义。

OpenAI 想要的不是让 ChatGPT 更会聊天,而是让 ChatGPT 变成一个任务入口。

我们该怎么适应?

如果你只是普通用户,不需要立刻追每一个新模型。

但有三件事可以现在开始练。

1. 把需求写成任务,而不是问题

不要只说:

帮我分析一下这个产品。

试着说:

请阅读这三份资料,提取产品的核心功能、目标用户、定价方式和差异化卖点,整理成一张表格。最后用 500 字总结它对国内 AI 工具创业者的启发,并列出 3 个值得继续研究的问题。

问题是给聊天模型的。

任务是给工作模型的。

以后这两者的差距会越来越大。

2. 搭自己的工具链

别只收藏提示词。

更重要的是想清楚:你的 AI 能接触哪些工具?

比如:

- 你的知识库;

- 你的代码仓库;

- 你的浏览器;

- 你的自动化脚本;

- 你的发布流程;

- 你的测试环境;

- 你的素材库。

一个普通模型,加上一套好工具链,可能比一个裸奔的强模型更有用。

这也是未来个人生产力的分水岭。

3. 学会验收 AI 的结果

AI 越能干活,人越不能只看最终文字顺不顺。

你要学会验收:

- 来源是否可靠;

- 代码是否真的运行;

- 数据是否能复算;

- 结论是否过度推断;

- 有没有安全风险;

- 有没有破坏现有工作流。

未来厉害的人,不是完全相信 AI 的人,也不是拒绝 AI 的人。

而是能让 AI 高速产出,同时把质量控制住的人。

结尾:别再只问它聪不聪明了

GPT-5.5 当然是一款更强的模型。

但如果只把它看成「GPT-5.4 的升级版」,就低估了这次发布的意义。

我更愿意把它看成 OpenAI 的一次产品宣言:

AI 不该只停留在回答问题。

AI 应该进入工具,进入流程,进入团队,进入真实工作。

下一阶段的大模型竞争,可能不会只是谁更聪明,而是谁更能把事情做完。

这也是我们该调整视角的地方。

以后评价一个 AI,别只问:

它回答得怎么样?

还要问:

它能交付什么?